Apunts CCFF Informàtica

Materials didàctics per als mòduls del CFGS en Desenvolupament d’Aplicacions Multiplataforma.

- Serveis i processos: mòdul 0490 de DAM

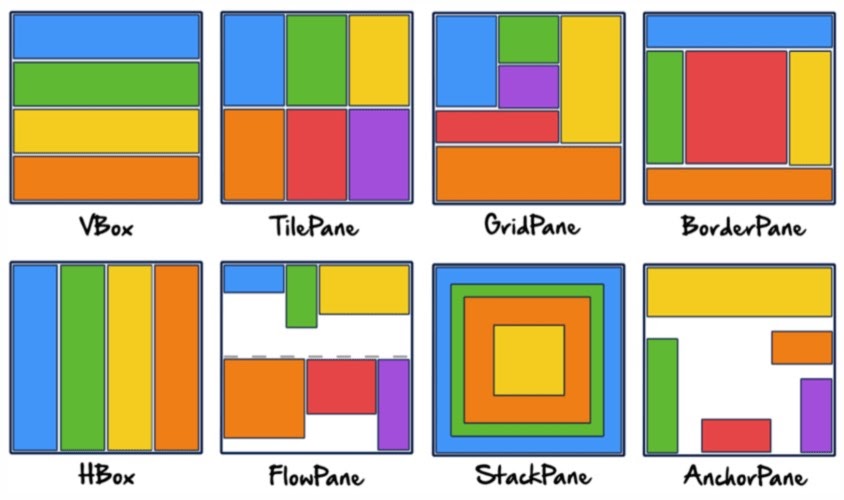

- Interfícies: mòdul 0488 de DAM

- IA i Ciència de dades: mòdul optatiu de DAM

- Fonaments de programació: conceptes generals de programació

- Eines IA per al desenvolupament: eines IA basades en agents

- Programació en Java: àmbits de programació amb Java

- Web: programació en l’entorn web

- Persistència: conceptes bàsics de persistència

- Empresa: continguts d’emprenedoria

Continguts publicats sota llicència CC BY-NC-SA 4.0.

Contacte:

Serveis i processos

Processos i fils

Referències

- Java Concurrency Terminology

- Java Language Specification, capítol 17: Threads and Locks

- The Java tutorials: Concurrency

- Java Concurrency and Multithreading Tutorial

- Threads (Java in a nutshell)

- How to work with wait(), notify() and notifyAll() in Java?

- Thread Communication using wait/notify

- The evolution of the producer / consumer problem in Java

- Java CompletableFuture Tutorial with Examples

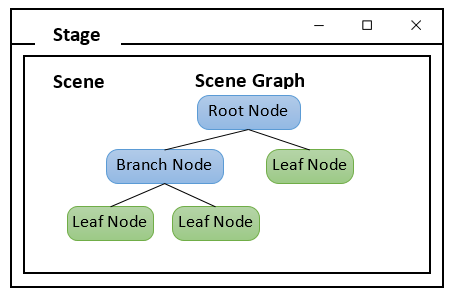

- Concurrency in JavaFX 8

- Liveness (The Java Tutorials, Oracle)

- Liveness (Wikipedia)

- The Deadlock Empire

- Thread Safety (6.005: Software Construction)

- What is Thread Dump and How to Analyze them?

- Concurrency: A Primer

Programació i sistemes reactius:

- Reactive Programming: Why It Matters

- Reactive programming vs Reactive systems

- RxJava Wiki

- RxJava Backpressure

- Reactive Manifesto (Glossary)

- Poor Man’s Actors in Java

- Reactive in practice: A complete guide to event-driven systems development in Java

- Reactive Programming with Reactor 3

Concurrència

Concurrència i paral·lelisme

La computació concurrent permet que diverses tasques dins d’una aplicació puguin executar-se sense un ordre concret, fora d’una seqüència. O sigui: no cal que una tasca es completi perquè comenci la següent. Aquesta és una propietat de l’algorisme. És a dir, cal que dissenyem la nostra aplicació perquè ho permeti.

La computació concurrent no implica que l’execució es produeix en el mateix instant de temps. La computació paral·lela sí que fa referència a l’execució en el mateix instant de temps, i treu profit de sistemes amb múltiples cores per a accelerar la computació. És una propietat de la màquina.

Per una banda, hi ha situacions on les aplicacions són inherentment concurrents. Per una altra, si no dissenyem concurrentment, les nostres aplicacions no poden aprofitar les arquitectures hardware multi-core de les CPU dels ordinadors, i estarem limitats a la capacitat i rendiment d’un sol core.

Processos i fils

El planificador o scheduler d’un sistema és el mecanisme que permet assignar tasques a treballadors. A una aplicació, una tasca sol traduir-se en un fil o thread i un treballador en un core de CPU. L’assignació fa que el planificador substitueixi una tasca per un altra. D’això se’n diu canvi de context (context switching). És un procés pesat per als processos, amb un context més gran, i lleuger per als fils, amb un context més petit.

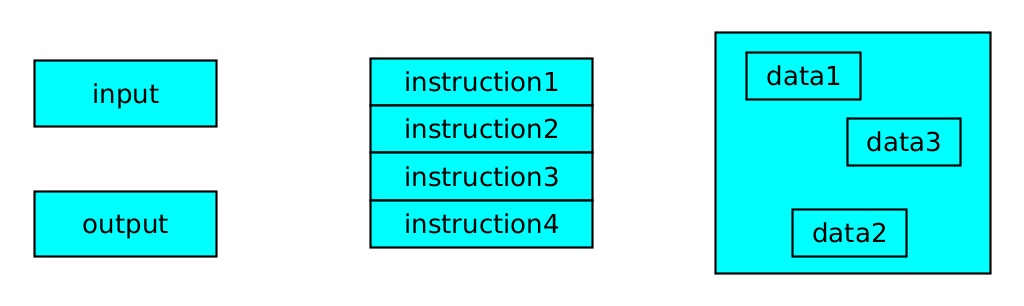

La unitat bàsica d’execució d’un sistema operatiu és el procés, que són col·leccions de codi, memòria, dades i altres recursos. Un procés té un entorn independent d’execució, simulant un ordinador. Per exemple, té el seu espai independent de memòria. Solen ser sinònim de programa, o aplicació, encara que pugui ser un conjunt de processos.

Un fil és una seqüència de codi que s’executa dins de l’àmbit del procés, i que pot compartir dades amb altres fils. Un fil és la seqüència mínima d’instruccions que gestiona un scheduler. Un procés pot tenir diversos fils executant-se simultàniament a dins.

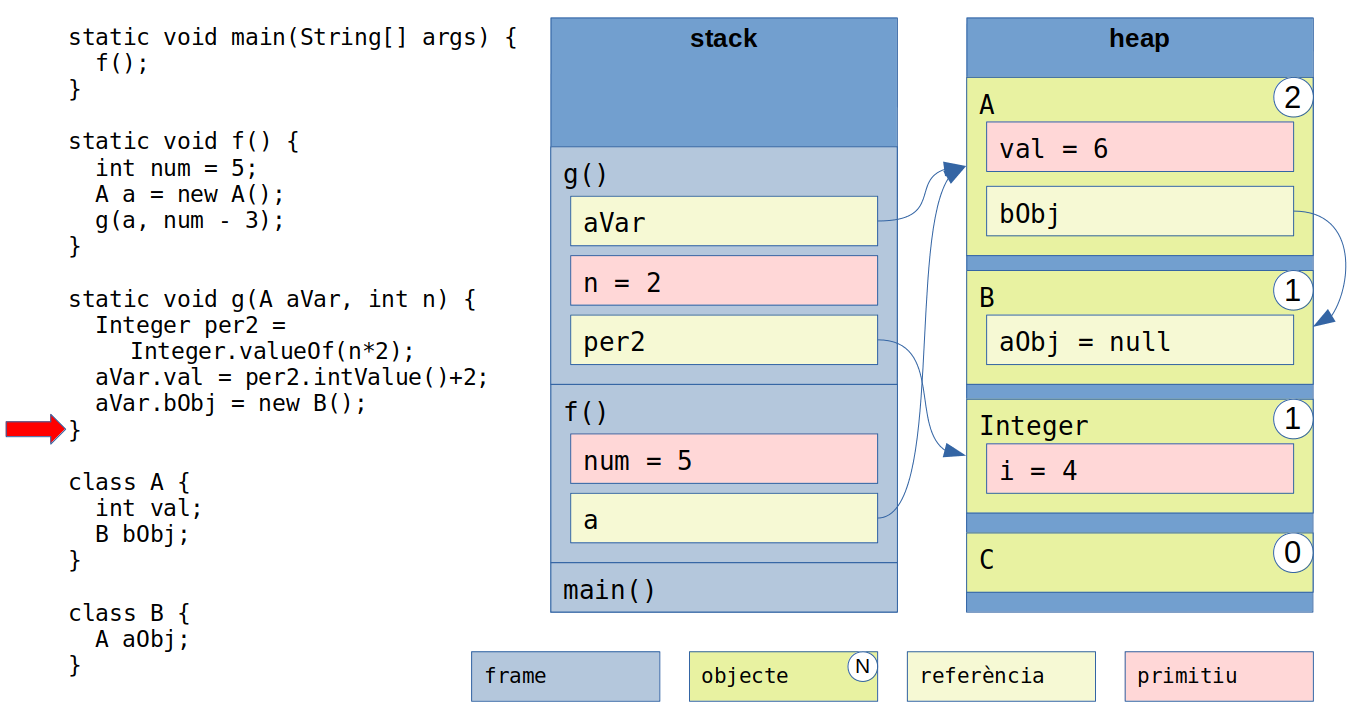

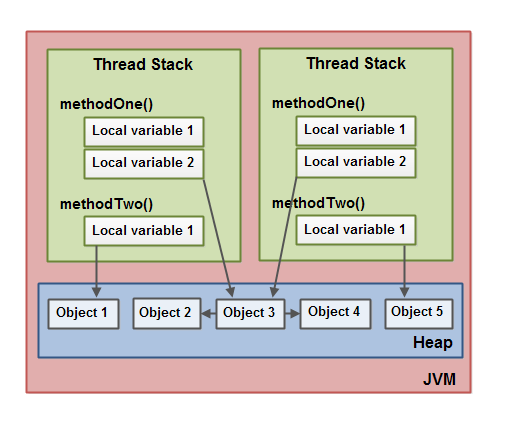

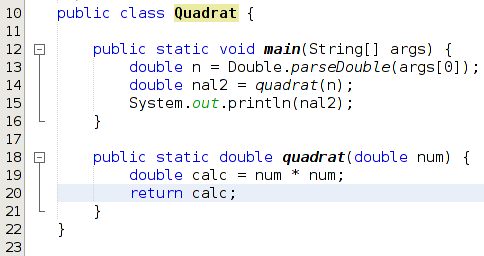

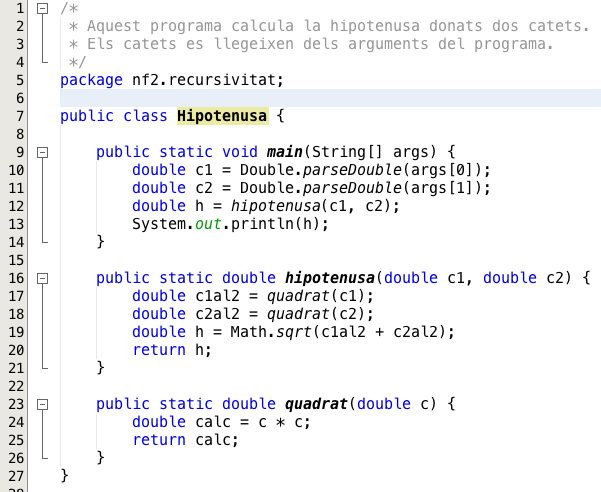

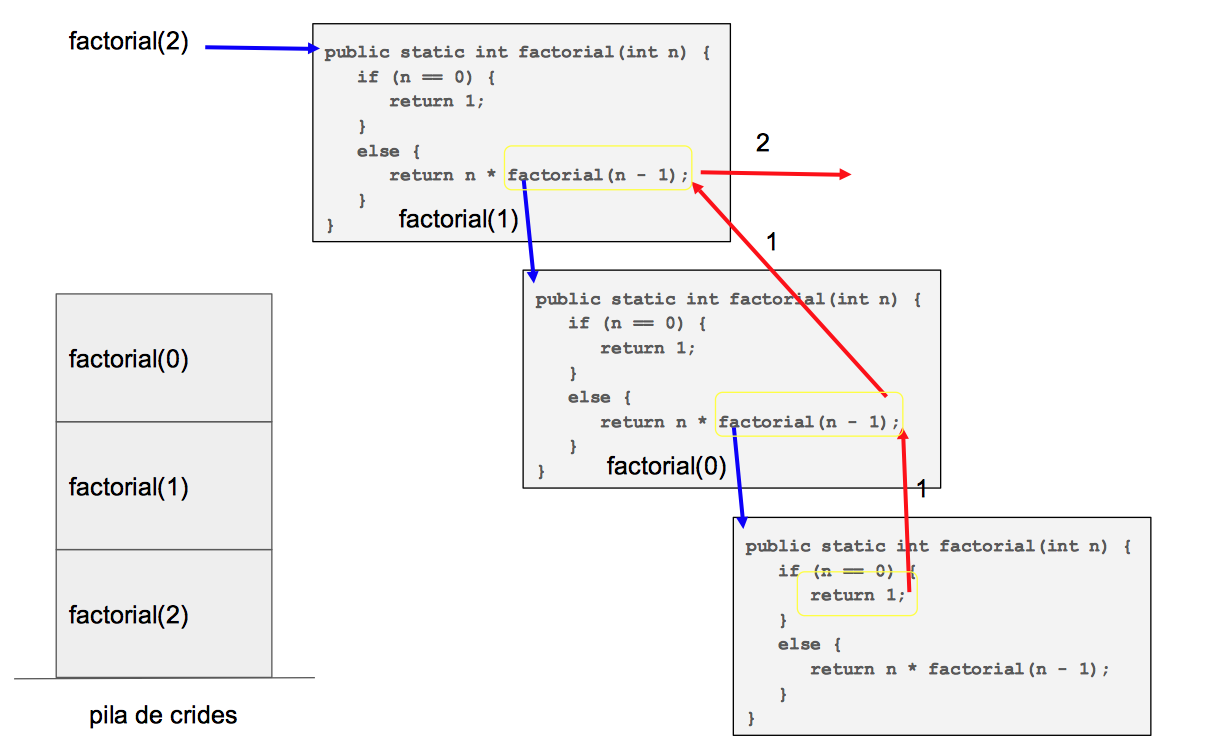

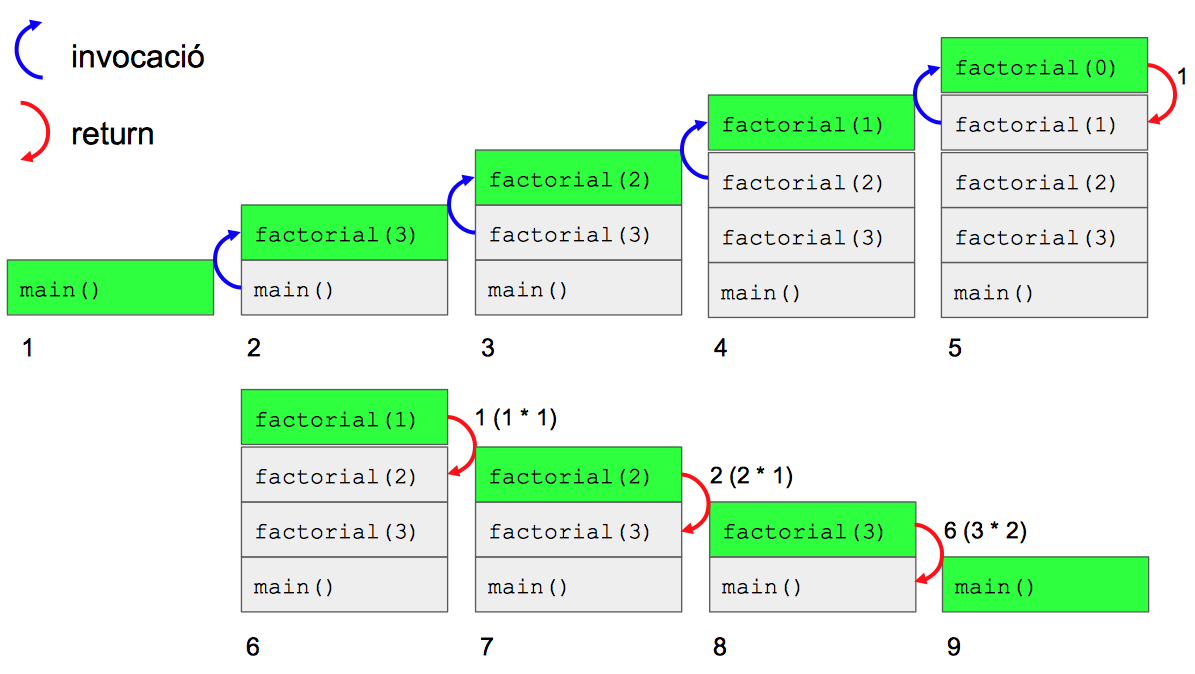

Quan desenvolupem una aplicació, les seves dades es troben en dos espais de memòria diferents: el heap i la pila de crides (call stack):

-

Pila de crides (call stack): estructura de dades que guarda les rutines actives d’un fil apilades en frames. El frame es crea quan es fa una crida, i s’esborra quan s’acaba la rutina. Cada frame conté:

- L’adreça de retorn

- Els paràmetres de la rutina

- Les variables locals

-

Heap: espai dinàmic de memòria que s’assignen quan es creen dades i es desassignen quan s’esborren. Habitualment aquí trobem els objectes.

El processos són totalment independents, no comparteixen res a la pila o el heap. Els fils poden compartir dades del heap.

Aplicacions de la concurrència

La programació ens permet implementar concurrència de diverses formes segons el llenguatge i el context del desenvolupament. Aquests són possibles casos d’ús:

- A una UI, fer operacions en un treballador independent que no bloquegi la interfície.

- Implementar alarmes i temporitzadors.

- Implementació d’algorismes paral·lels.

- Implementar tasques de múltiples clients concurrents, accedint a recursos compartits.

Models de concurrència

Una tasca pot caracteritzar-se, segons el seu tipus d’activitat, com:

- Limitada per la CPU: és una tasca que necessita la CPU per fer càlculs intensius.

- Limitada per l’E/S (Entrada/Sortida): és una tasca que habitualment està esperant per una operació d’entrada/sortida, com pot ser llegir o escriure a disc o a la xarxa.

L’assignació de tasques del scheduler pot ser de dos tipus: cooperativa o apropiativa.

- Cooperativa: les tasques gestionen el seu cicle de vida, i decideixen quan abandonen el treballador.

- Apropiativa: el scheduler assigna un time slice per a la tasca, i la treu del treballador quan es compleix.

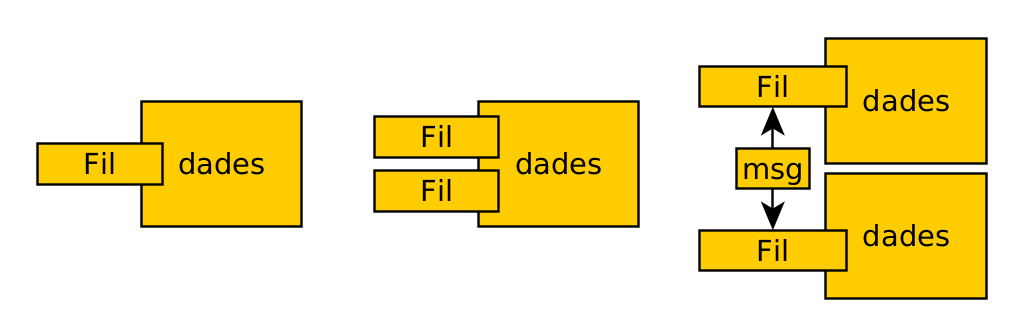

El principal repte per implementar la concurrència és la correcta coordinació entre tasques i l’accés als recursos compartits de manera segura. Aquests són alguns dels enfocaments disponibles:

- Un sol fil: només tenim un fil que es comparteix entre les tasques.

- Estat compartit (o memòria compartida): dues o més tasques comparteixen un estat que totes poden llegir i escriure, i diversos mecanismes permeten fer-ho de manera segura.

- Pas de missatges: no es comparteix res. En el seu lloc, s’intercanvien missatges.

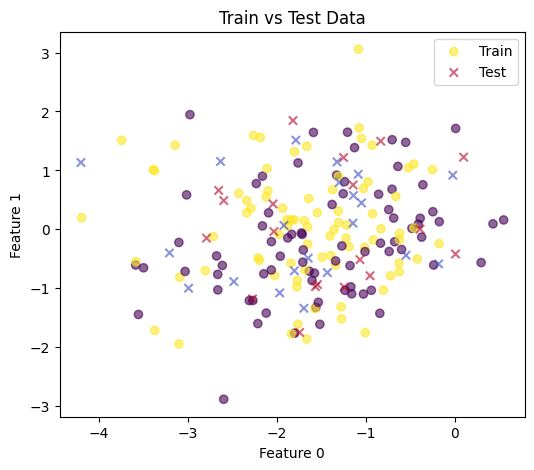

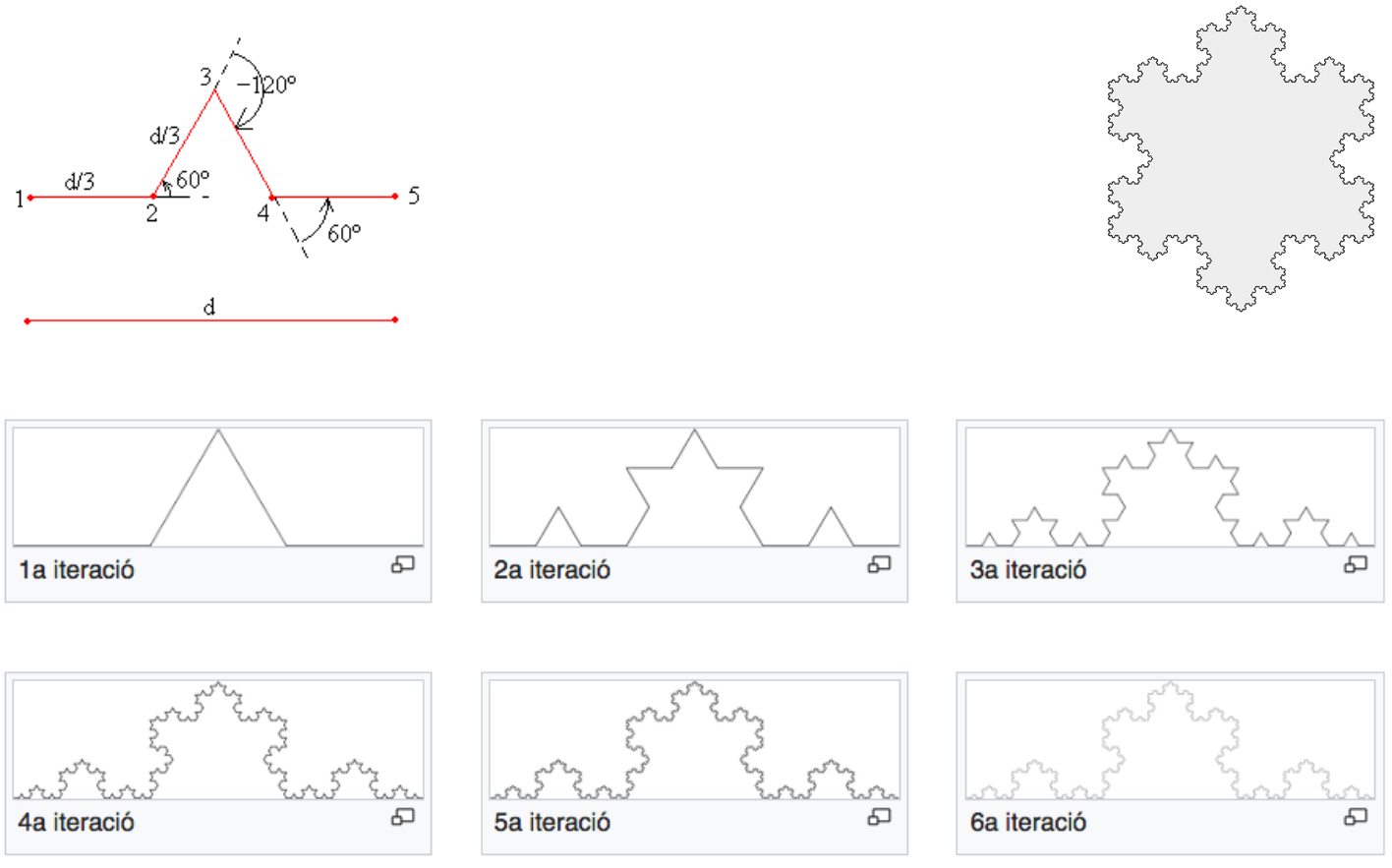

El següent diagrama mostra el model d’un sol fil, el de memòria compartida i el de pas de missatges.

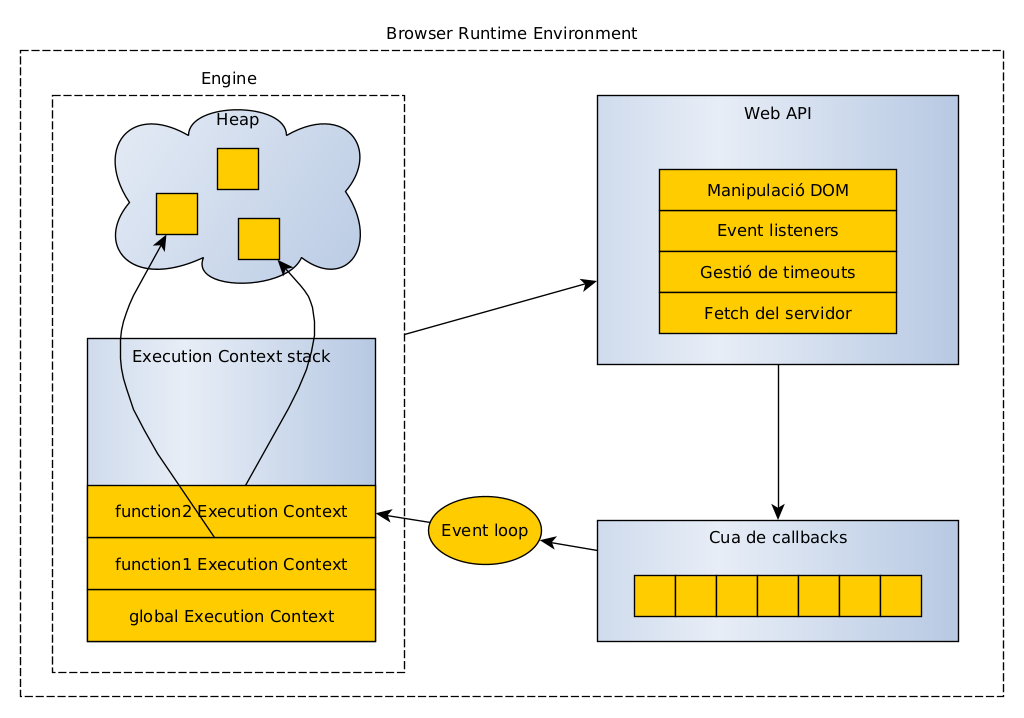

Un sol fil

Aquesta opció simplifica el disseny de la concurrència, ja que no cal utilitzar mecanismes per a gestionar l’accés simultani a recursos compartits. Té el desavantatge que no es poden paral·lelitzar les tasques, però això només és un problema si estan limitades per CPU.

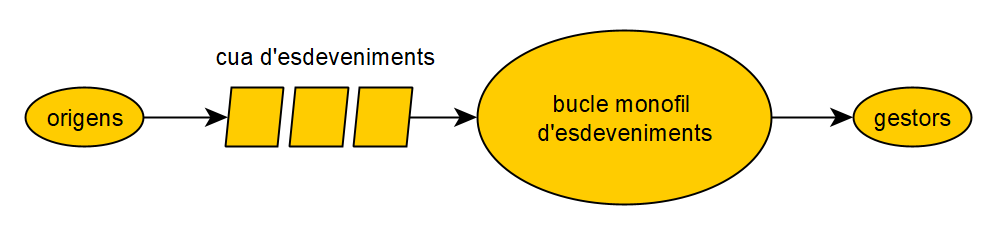

Un exemple habitual és el del bucle d’esdeveniments de les UI. S’implementa amb una cua que rep els esdeveniments i els gestiona ràpidament, ja que només realitzen operacions asíncrones.

Estat compartit

Les tasques concurrents interaccionen llegint i escrivint objectes compartits i mutables en memòria. És complex, ja que cal implementar mecanismes de bloqueig per coordinar els fils.

Imaginem que els fils A i B utilitzen un mateix codi per a compartir els objectes mutables. Aquest codi, que permet que diversos fils l’accedeixin simultàniament de forma segura, s’anomena “thread-safe”.

Hi ha quatre estratègies que veurem: confinament, immutabilitat, tipus thread-safe i sincronització.

Pas de missatges

Les tasques concurrents interaccionen enviant-se missatges entre ells (1:1 o N:1) a través d’un canal de comunicació. Les tasques envien missatges amb objectes immutables, i els missatges entrants de cada tasca es col·loquen en cola per a la seva gestió. Ho poden fer de forma síncrona o asíncrona, en funció de si s’espera o no la resposta.

El pass de missatges es pot implementar en dos contextos: entre fils d’un procés (p.ex. cues i productor/consumidor) o entre processos d’una xarxa (p. ex. amb sòcols).

Estat compartit

El disseny de programari concurrent que comparteix dades es basa en la idea que els fils poden accedir a les mateixes dades, i que aquestes dades poden ser modificades per qualsevol fil.

Un exemple de llenguatge que utilitza aquest model és Java.

Tenim dos reptes a resoldre:

-

L’accés segur a les dades compartides. Quins mecanismes podem utilitzar per assegurar-nos que els fils accedeixen de forma segura a les dades compartides?

-

La coordinació entre els fils. Com podem gestionar l’ordre d’execució dels fils, sincronitzar-los quan calgui i gestionar les seves interaccions?

Accés segur

Si l’accés de tots els fils és només de lectura, no hi ha problema. El problema és quan hi ha accés simultani de lectura i escriptura.

HI ha dues situacions problemàtiques: la interferència de fils i la coherència de dades.

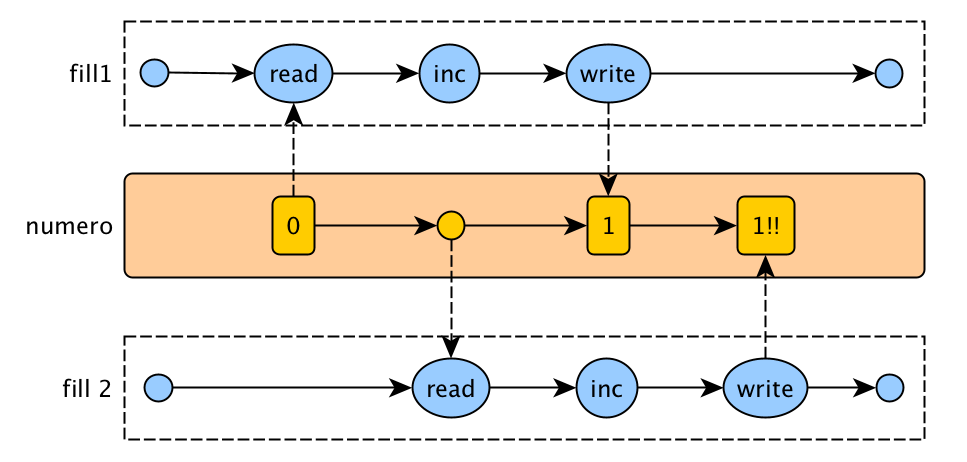

Interferència de fils

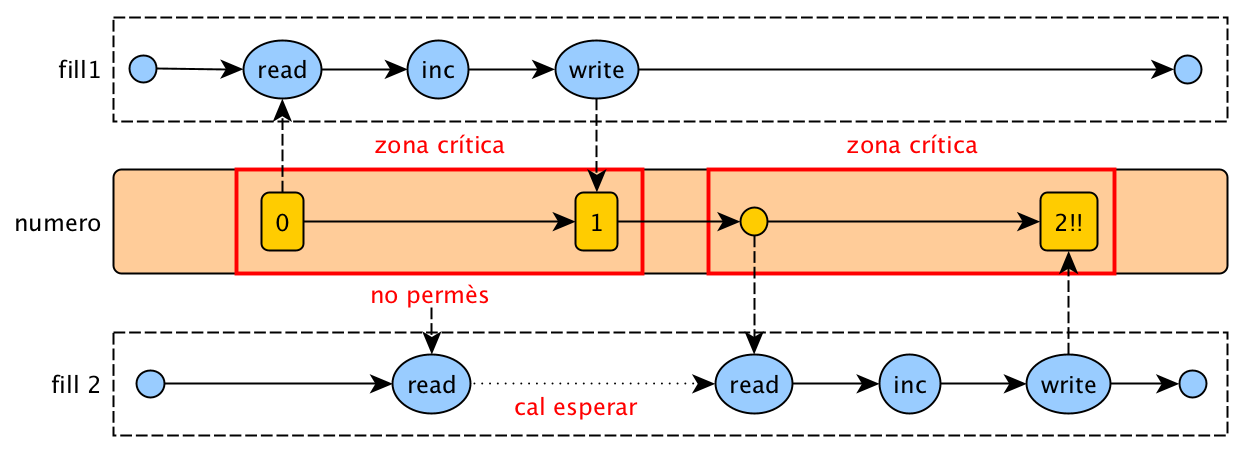

La interferència es produeix quan dues operacions, que s’executen en diferents fils, però que actuen sobre les mateixes dades, s’entrellacen. Això vol dir que les dues operacions consten de diversos passos i les seqüències de passos se superposen. Aquest fenomen també s’anomena race condition.

Per exemple: l’operació d’increment d’un comptador consta de llegir el valor actual, incrementar-lo i escriure el nou valor. Si dues operacions d’increment s’executen simultàniament, el resultat final pot ser erroni.

La solució és sincronitzar l’accés a les dades compartides, fent que cada operació s’executi de forma atòmica.

Coherència de dades

El problema és que dues operacions, que s’executen en diferents fils, però que actuen sobre les mateixes dades, no veuen els canvis que s’han fet en les dades. Això es deu a que els fils tenen una còpia local de les dades compartides, i no es veuen els canvis que fan els altres fils.

Per exemple, si un fil canvia una variable booleana de valor i un altre fil llegeix el valor, pot ser que no vegi el canvi. Això es deu a que el compilador pot optimitzar el codi, i no llegir el valor de la variable cada vegada que es fa servir, sinó que el guarda en un registre. Això fa que el fil no vegi els canvis que fan els altres fils.

Estratègies

Les possibles estratègies per a gestionar l’accés simultani a dades compartides són: confinament, immutabilitat, tipus thread-safe i sincronització.

- Confinament. No compartiu la variable entre fils.

- Immutabilitat. Feu que les dades compartides siguin immutables. Tots els camps de la classe han de ser finals.

- Tipus de dades thread-safe. Encapsulem les dades compartides en un tipus de dades existent amb seguretat que realitzi la coordinació.

- Sincronització. Utilitzeu la sincronització per evitar que els fils accedeixin al mateix temps establint zones crítiques de codi: fragments de codi que accedeixen a dades compartides i que s’han d’executar de forma atòmica.

Coordinació

A l’hora de dissenyar el flux del programari concurrent, fes-te aquestes preguntes:

- Cal entendre la solució al problema. Habitualment, parteix de la solució seqüencial, per trobar la concurrent.

- Considera si pot ser paral·lelitzada. Alguns problemes són inherentment seqüencials.

- Pensa en les oportunitats de paral·lelitzar que permeten les dependències entre les dades. Si no hi ha dependències, podem descompondre-les i paral·lelitzar-les.

- Busca els llocs on la solució consumeix més recursos, com a candidats de paral·lelització.

- Descompon en tasques el problema, per veure si aquestes poden ser executades independentment.

Aquests són alguns mecanismes disponibles a diferents llenguatges per a coordinar els fils:

- Crear una o més tasques que aniran executant-se en paral·lel.

- Que un fil esperi que es completi un altre (join).

- Que un fil notifiqui a un altre que ha completat una tasca (notify).

- Que un fil esperi que un altre li notifiqui que ha completat una tasca (wait).

- Que un fil envii un senyal d’interrupció a un altre fil (interrupt).

Vitalitat (liveness) d’un sistema multifil

La vitalitat d’una aplicació (liveness) és la seva capacitat per a executar-se en el temps que toca. Els problemes més habituals que poden desbaratar aquesta vitalitat són:

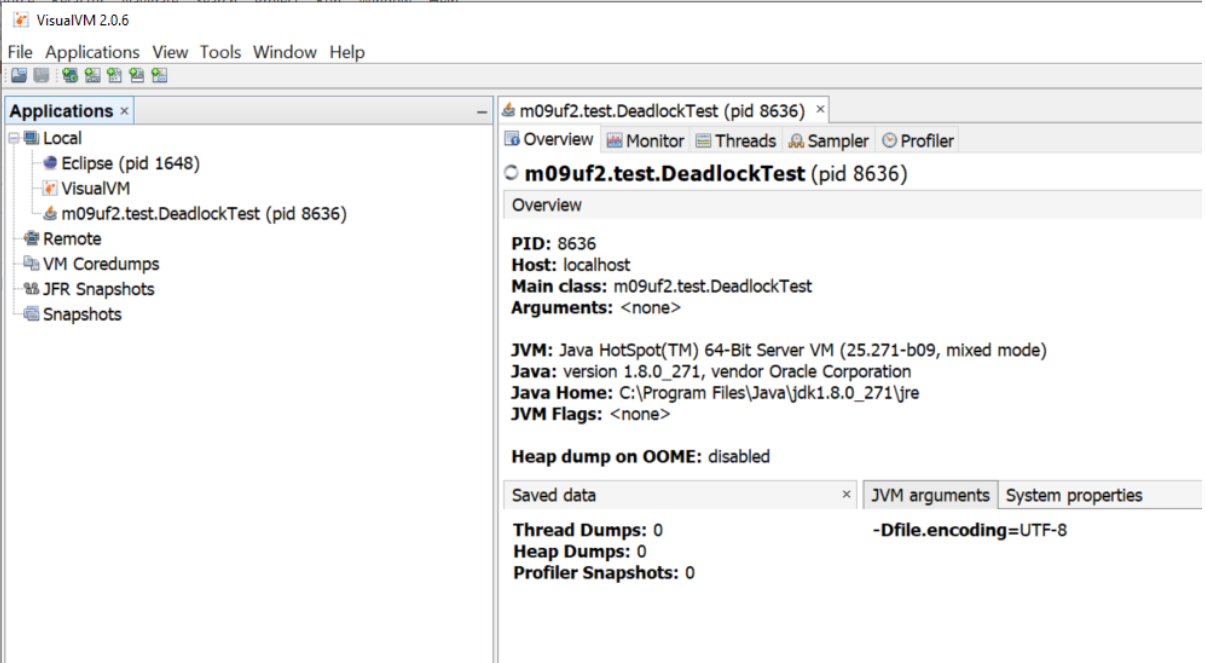

- El deadlock (interbloqueig): dos o més fils es bloquegen per sempre, esperant l’un per l’altre. Pot passar si dos fils bloquegen recursos que necessiten esperant que estiguin lliures d’altres, que mai ho seran.

- La starvation (inanició): la denegació perpètua dels recursos necessaris per a processar una feina. Un exemple seria l’ús de prioritats, on sempre els fils amb més prioritat són atesos, i els altres mai ho són.

- El livelock és molt semblant al deadlock, però els fils sí que canvien el seu estat, tot i que mai s’arriba a una situació de desbloqueig.

Quan un client fa una petició a un servidor, el servidor ha d’aconseguir l’accés exclusiu als recursos compartits necessaris. L’ús correcte de les zones crítiques permetrà que el sistema tingui una millor vitalitat quan la càrrega de peticions sigui alta.

Java

Java és un llenguatge de programació d’alt nivell orientat a objectes, compilat i interpretat. Els seus programes són compilats a bytecode, que és interpretat per la màquina virtual de Java (JVM). Aquesta màquina virtual és un procés que s’encarrega de gestionar la memòria i els seus fils d’execució.

El call stack de Java pot contenir dades primitives i referències a objectes. Els objectes es guarden al heap, i el Garbage Collector s’encarrega de gestionar la seva memòria.

El llenguatge Java implementa la concurrència fent ús del model d’estat compartit i fils.

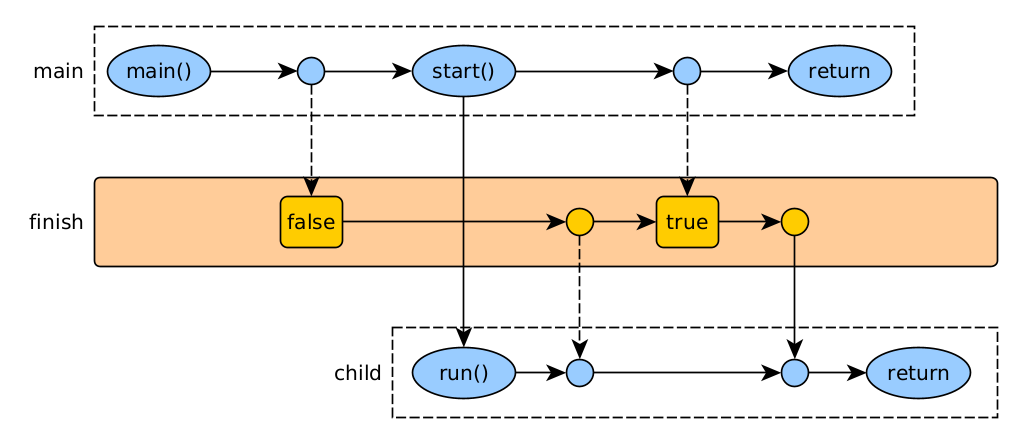

Una aplicació Java pot crear processos addicionals utilitzant ProcessBuilder. Aquesta classe permet crear processos de sistema (Process) i executar-los, parar-los, llegir la seva sortida, reencaminar-la, etc. Resumint, permet interactuar amb altres processos de sistema que no siguin de la màquina virtual Java.

Tanmateix, Java basa la seva implementació de concurrència en la utilització de fils d’execució, que serà el que veurem a continuació. Aquesta es pot implementar a dos nivells: l’API de baix nivell basada en fils i els objectes concurrents d’alt nivell.

Fils a Java

L’API de baix nivell de Java es basa en l’objecte Thread, que pot tenir una sèrie d’estats.

- NEW: Un fil que no s’ha iniciat.

- RUNNABLE: Un fil que s’està executant a la JVM. És possible que no tingui la CPU.

- BLOCKED: Un fil que està esperant per entrar a un bloc sincronitzat (esperant un monitor lock).

- WAITING: Un fil que espera indefinidament per un altre (operacions wait, join).

- TIMED_WAITING: Un fil que espera un cert temps per un altre (operacions sleep, wait, join).

- TERMINATED: Un fil que ha acabat. No es pot tornar a executar.

Podem crear un fil de dues maneres:

- Estendre la classe Thread i reescriure el mètode “run” (millor no utilitzar aquest mètode).

- Implementar la interfície Runnable i el seu mètode “run”. Llavors, crear un Thread passant aquest objecte al constructor:

new Thread(new MyRunnable())

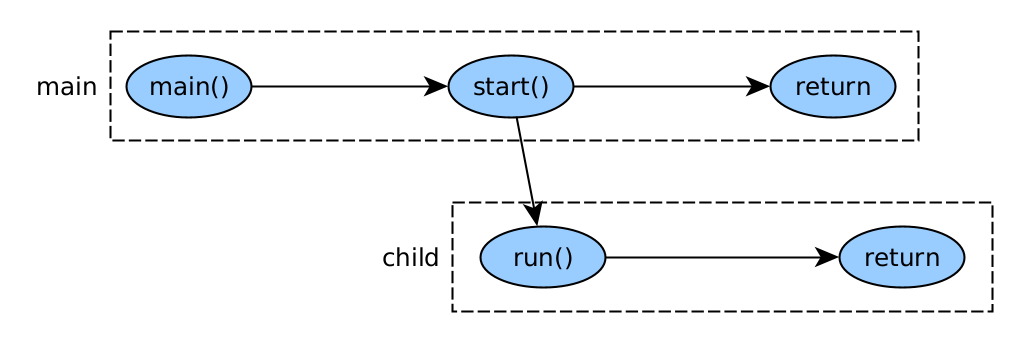

Un cop tenim el Thread, el podem executar mitjançant el seu mètode start(), que farà canviar el seu estat de NEW a RUNNABLE.

Per als exemples que veurem a continuació, utilitzarem la següent utility class:

public class Threads {

private static long start = System.currentTimeMillis();

private Threads() {}

public static void log(String message) {

System.out.println(String.format("%6d %-10s %s",

System.currentTimeMillis() - start,

Thread.currentThread().getName(), message));

}

public static void spend(long millis) {

long startTime = System.currentTimeMillis();

while (System.currentTimeMillis() - startTime < millis);

}

public static void rest(long millis) {

try {

Thread.sleep(millis);

} catch (InterruptedException e) {

throw new RuntimeException(e);

}

}

}

Els seus mètodes poden cridar-se després de fer un import static Threads.*;.

A continuació, podem veure un exemple de creació d’un fil anomenat “fil” des del fil principal, “main”. Mostra l’estat del fil “child” abans i després de la seva execució.

Aquest seria el codi:

public class StatesThread {

static class MyRunnable implements Runnable {

@Override

public void run() {

log("spending");

spend(750);

log("resting");

rest(750);

log("ending");

}

}

public static void main(String[] args) {

Thread thread = new Thread(new MyRunnable(), "child");

log(thread.getState().name());

thread.start();

rest(250);

log(thread.getState().name());

rest(875);

log(thread.getState().name());

rest(500);

log(thread.getState().name());

}

}

Aquesta podria ser una sortida per pantalla possible:

0 main NEW

8 child spending

258 main RUNNABLE

758 child resting

1133 main TIMED_WAITING

1508 child ending

1633 main TERMINATED

Aquest exemple no presenta dificultats, ja que no es comparteix cap dada. Tampoc s’utilitza cap mecanisme de sincronització entre els dos fils.

Tècniques de disseny

Hi ha bàsicament quatre tècniques per assegurar-nos que no tindrem problemes accedint a variables en memòria compartida. Són aquestes, per ordre de preferència:

- Confinament. No compartiu objectes entre fils.

- Immutabilitat. Feu que les dades compartides siguin immutables. Tots els camps de la classe han de ser finals.

- Utilitzar tipus de dades thread-safe. Encapsulem les dades compartides en un tipus de dades existent amb seguretat que realitzi la coordinació.

- Per exemple, el paquet java.util.concurrent també conté algunes classes concurrents de mapes, cues, conjunts, llistes i variables atòmiques. Aquestes classes es poden utilitzar i compartir sense por a provocar race conditions.

- Sincronització. Utilitzeu la sincronització per evitar que els fils accedeixin les dades al mateix temps.

- Els objectes monitor són objectes a què només pot accedir un fil alhora. Aquests permeten definir zones crítiques de codi. És el mètode més utilitzat.

- També es pot utilitzar els reentrant locks (lock / unlock).

A continuació veurem un exemple de race condition, el problema més representatiu de l’estat compartit entre fils. Dos fils intenten incrementar un comptador a un objecte compartit. El resultat final no és el que esperem:

public class RaceThread {

static class SharedObject {

int counter;

}

static class MyRunnable implements Runnable {

SharedObject so;

MyRunnable(SharedObject so) {

this.so = so;

}

void increment() {

so.counter ++;

}

@Override

public void run() {

for (int i=0; i<1_000_000; i++) {

increment();

}

}

}

public static void main(String[] args) throws InterruptedException {

SharedObject so = new SharedObject();

Thread t1 = new Thread(new MyRunnable(so));

Thread t2 = new Thread(new MyRunnable(so));

t1.start();

t2.start();

t1.join();

t2.join();

log("counter is " + so.counter);

}

}

En aquest exemple, el mètode increment() no és thread-safe. El resultat és que el valor de counter no és el que esperàvem. Això és degut a que el mètode increment() no és atòmic. Això vol dir que no és una única operació, sinó que es descompon en diverses operacions més petites. És el que es diu una operació composta. El problema és que cada petita operació pot intercalar-se entre diversos fils i generar un problema.

En el nostre cas, el compilador descompon el mètode increment() en tres operacions anomenades Read-Modify-Write:

- Llegir el valor de

counterde memòria. - Incrementar el valor llegit.

- Escriure el valor incrementat a memòria.

Aquestes són algunes operacions compostes habituals:

- Read-Modify-Write (l’exemple)

- Check-Then-Act: per exemple, inicialitzar si cal (singleton)

- Put-If-Absent: afegir un element a una col·lecció si no existeix

Per a sincronitzar, necessitem definit el concepte de monitor (lock): un monitor és un objecte que només pot ser accedit per un únic fil al mateix temps. En el nostre problema, el monitor seria l’objecte so. Cada fil ha d’adquirir el monitor abans d’accedir a la variable counter. Això es fa amb la paraula clau synchronized.

Una primera solució seria no permetre l’accés directe al camp counter de l’objecte so. En aquest cas, el camp counter seria private i només es podria accedir a ell a través de mètodes. Aquests mètodes serien sincronitzats:

static class SharedObject {

private int counter;

synchronized void increment() {

counter ++;

}

synchronized int getCounter() {

return counter;

}

}

I canviar el mètode increment

Una segona solució seria fer que dos fils no poguessin accedir a la variable counter al mateix temps. Això a Java es fa utilitzant un monitor (lock). El mètode increment() quedaria així:

void increment() {

synchronized (so) {

so.counter ++;

}

}

Quan creem zones crítiques de codi amb els mecanismes de Java podem ordenar els esdeveniments que es produeixen. Les regles d’ordenació s’expliquen amb el concepte de “happen-before” (passa-abans). Resumint, es tracta de que si un esdeveniment A passa abans que un esdeveniment B, aleshores B no pot passar abans que A. Això ens permet assegurar-nos que els esdeveniments es produeixen en l’ordre que volem.

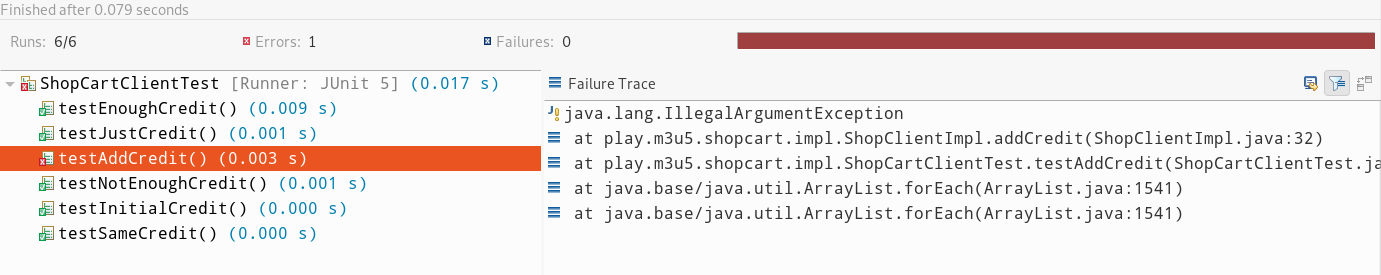

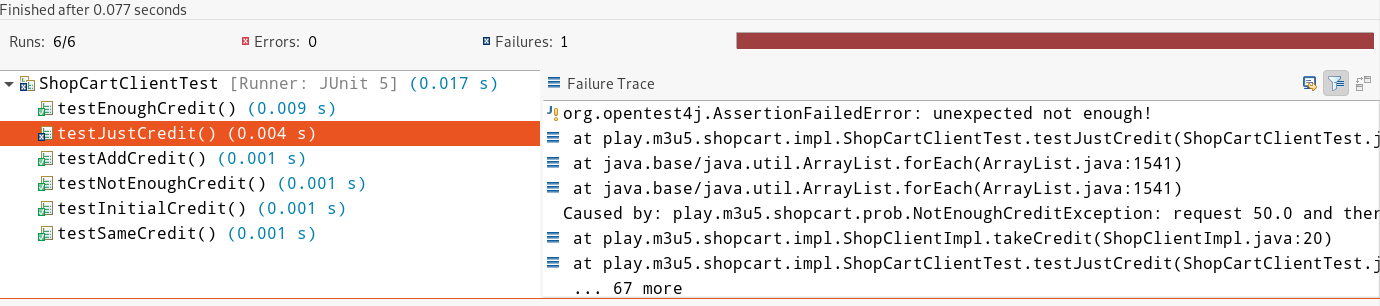

Hi ha una dificultat important a l’hora de dissenyar codi thread-safe, és a dir, que sigui segur davant l’accés de múltiples fils. Es poden preparar proves per al nostre codi que comprovin si, un nombre important de fils executant simultàniament el nostre codi, provoca problemes. Però no sempre és fàcil simular aquesta situació.

Si mirem la documentació de la Java Standard Edition, veurem que de vegades es fa referència a la condició “thread-safe” de les classes.

Per exemple, a la classe java.util.regex.Pattern es diu:

- Instances of this class are immutable and are safe for use by multiple concurrent threads. Instances of the

Matcherclass are not safe for such use.

És important que quan dissenyem el nostre codi siguem conscients de si necessitem que més d’un fil accedeixi. I si és així, dissenyar la classe en conseqüència i documentar-ho.

Join, interrupt i volatile

Join

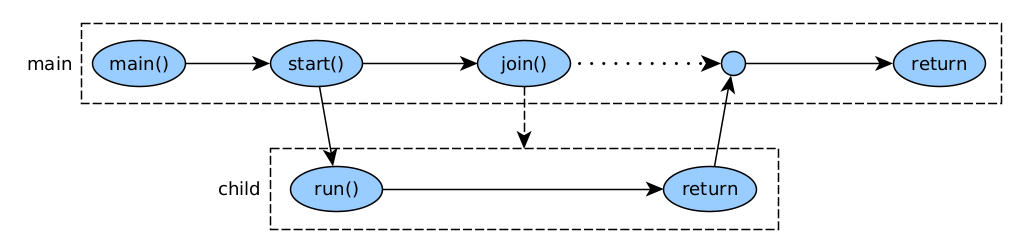

Un join fa que un fil s’esperi a la finalització d’un altre. El fil que fa el join passa a l’estat WAITING fins que el fil que s’espera acaba. Si el fil que s’espera ja ha acabat, el join no fa res.

public class JoinThread {

static class MyRunnable implements Runnable {

@Override

public void run() {

log("starting");

spend(1500);

log("ending");

}

}

public static void main(String[] args) throws InterruptedException {

Thread thread = new Thread(new MyRunnable(), "child");

log("starting");

thread.start();

log("started");

thread.join();

log("joined");

}

}

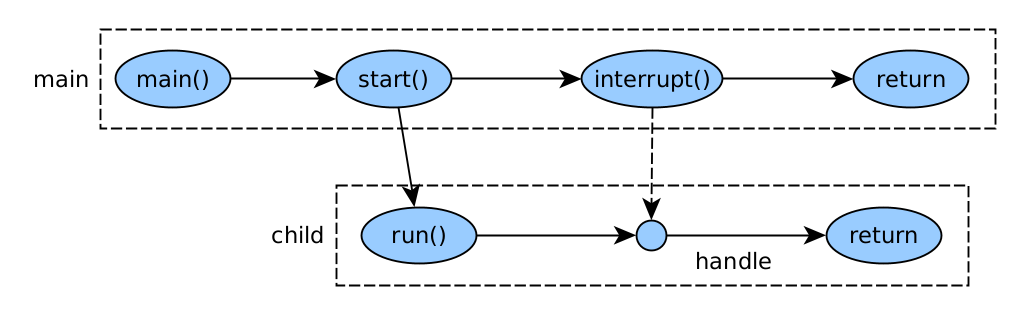

Interrupt

Una interrupció és una indicació a un fil de què ha de parar de fer el que està fent i fer una altra cosa. Els fils tenen un flag que indica si han estat interromputs o no. Hi ha dues formes de comprovar si un fil ha estat interromput:

- Que el fil faci crides freqüents a mètodes que facin throw de InterruptedException. Per exemple, Thread.sleep(). També serveix si la interrupció s’ha produït abans del sleep().

- Que el fil comprovi freqüentment Thread.currentThread().isInterrupted().

Un cop feta la comprovació i detectada la interrupció, el flag d’interrupció del fil es retorna a false i cal decidir què fer. Normalment, el que farà és acabar la seva execució, però no és obligatori. Si no es fa res, el fil continuarà executant-se.

public class Interrupt1Thread {

static class MyRunnable implements Runnable {

@Override

public void run() {

log("starting");

try {

Thread.sleep(1500);

} catch (InterruptedException e) {

log("interrupted!");

}

log("ending");

}

}

public static void main(String[] args) throws InterruptedException {

Thread thread = new Thread(new MyRunnable(), "child");

log("starting");

thread.start();

log("started");

thread.interrupt();

thread.join();

log("joined");

}

}

public class Interrupt2Thread {

static class MyRunnable implements Runnable {

@Override

public void run() {

log("starting");

while (!Thread.currentThread().isInterrupted());

log("ending");

}

}

public static void main(String[] args) throws InterruptedException {

Thread thread = new Thread(new MyRunnable(), "child");

log("starting");

thread.start();

log("started");

rest(1500);

thread.interrupt();

thread.join();

log("joined");

}

}

Estat compartit

Es pot acabar un fil compartint una variable que un fil modifica i l’altre llegeix. En Java, cal definir la variable com a volatile, indicant que els canvis fets en un fil siguin visibles en la resta. O bé utilitzar objectes segurs creats per nosaltres (mecanismes de sincronització) o d’una llibreria segura (p. ex. la atomic de Java).

La paraula clau volatile només s’ha d’utilitzar si un fil escriu i l’altre (o altres) llegeixen. Si diversos fils escriuen i llegeixen, cal gestionar-ho com a zones crítiques.

public class VolatileThread {

static class SharedObject {

boolean done; // volatile keyword needed

}

static class MyRunnable1 implements Runnable {

SharedObject so;

MyRunnable1(SharedObject so) {

this.so = so;

}

@Override

public void run() {

spend(1500);

so.done = true;

}

}

static class MyRunnable2 implements Runnable {

SharedObject so;

MyRunnable2(SharedObject so) {

this.so = so;

}

@Override

public void run() {

boolean done = false;

while (!done) {

done = so.done;

}

}

}

public static void main(String[] args) throws InterruptedException {

SharedObject so = new SharedObject();

Thread t1 = new Thread(new MyRunnable1(so));

Thread t2 = new Thread(new MyRunnable2(so));

t1.start();

t2.start();

t1.join();

log("joined 1 with " + so.done);

t2.join();

log("joined 2 with " + so.done);

}

}

Mecanismes de sincronització

Monitors (intrinsic lock)

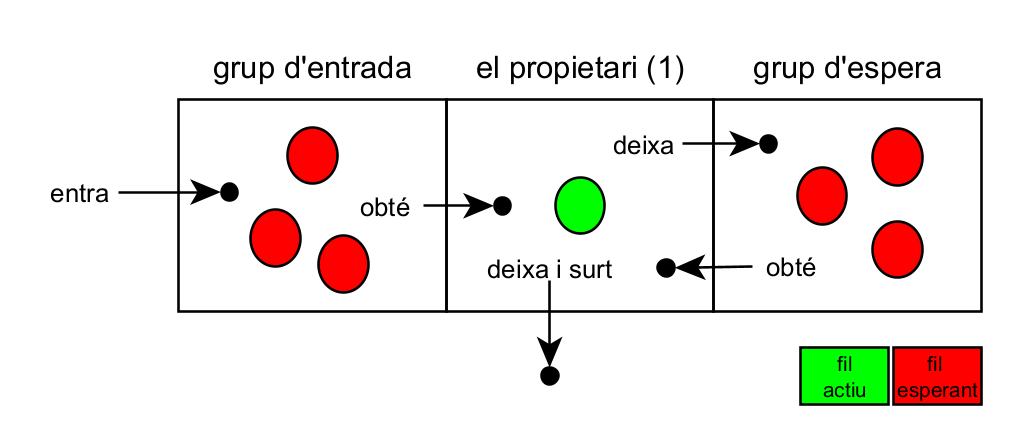

A Java, la sincronització es fa mitjançant monitors. Un monitor és un objecte qualsevol que pot tenir un únic fil propietari. Qualsevol fil pot demanar la propietat d’un monitor i a canvi accedir a una zona crítica de codi restringida. Si ja hi ha propietari, cal que s’esperi fins que ho deixi de ser.

Per demanar la propietat d’un monitor i l’accés a la zona crítica de codi, podem utilitzar la paraula reservada “synchronized”. En funció d’on ho fem, l’objecte monitor canvia:

- Mètodes d’instància: L’objecte monitor és la instància. Per tant, només un fil per cada instància.

- Mètodes de classe: L’objecte monitor és la classe. Per tant, només un fil per cada classe.

- Blocs de codi: s’ha d’indicar l’objecte monitor dins dels parèntesis. Qualsevol objecte pot ser monitor (p. ex.

new Object()), tot i que habitualment fem que el monitor sigui el mateix objecte sobre el qual volem exercir control d’accés.

Un exemple de mètodes d’instància:

public class SynchronizedCounter {

private int c = 0;

public synchronized void increment() {

c++;

}

public synchronized void decrement() {

c--;

}

public synchronized int value() {

return c;

}

}

Conseqüències:

- Primer, no és possible que dos fils puguin cridar simultàniament a dos mètodes sincronitzats. Les subseqüents crides se suspenen fins que el primer fil acabi amb l’objecte.

- Segon, quan un mètode sincronitzat acaba, estableix una relació happens-before: les crides subseqüents tindran visibles els canvis fets.

Important: dins d’un bloc sincronitzat, cal fer la feina mínima possible: llegir les dades i si cal, transformar-les.

Un exemple de blocs de codi:

public class MsLunch {

private long c1 = 0;

private long c2 = 0;

private Object lock1 = new Object();

private Object lock2 = new Object();

public void inc1() {

synchronized(lock1) {

c1++;

}

}

public void inc2() {

synchronized(lock2) {

c2++;

}

}

}

Aquest mètode permet tenir un gra més fi: pot haver-hi un fil a la zona de codi de lock1 i un altre a la de lock2.

Wait / Notify (guarded lock)

Imaginem que volem esperar fins que es compleixi una condició:

public void waitForHappiness() {

// Simple method, wastes CPU: never do that!

while (!hapiness) {}

System.out.println("Happiness achived!");

}

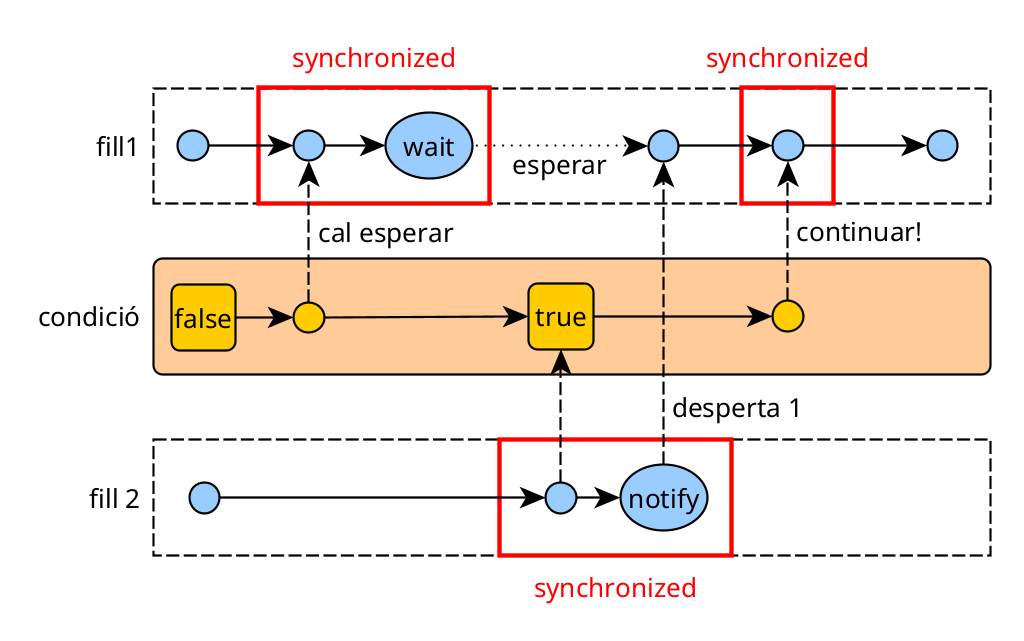

Això ho podem fer entre fils mitjançant el mètode clàssic de comunicació wait i notify, que permet:

- Esperar fins que una condició que implica dades compartides sigui certa, i

- notificar a altres fils que les dades compartides han canviat, probablement activant una condició per la que esperen altres fils.

Els mètodes són:

- wait(): quan es crida, el fil actual espera fins que un altre fil cridi notify() o notifyall() sobre aquest monitor.

- notify(): desperta un fil qualsevol de tots els que estiguin esperant a aquest monitor.

- notifyAll(): desperta tots els fils que estiguin esperant a aquest monitor.

Els mètodes wait() i notify s’han de cridar des de dins d’un bloc sincronitzat per a l’objecte monitor.

A més, tal i com es comenta a Object, el mètode wait() ha de ser a dins d’un bucle esperant per una condició:

// in one thread:

synchronized (monitor) {

while (!condition) {

monitor.wait();

}

}

// in the other thread:

synchronized (monitor) {

monitor.notify();

}

En el nostre cas:

synchronized (monitor) {

while (!happiness) {

monitor.wait();

}

}

...

synchronized (monitor) {

happiness = true;

monitor.notify();

}

Funcionament del wait / notify

- El fill 1 obté el monitor i comprova si la condició és true per acabar el loop.

- Com que és false, fa wait() i deixa el monitor.

- El fill 2 obté el monitor, canvia la condició a false i fa notify().

- El fill 1 es desperta i passa a ‘ready’, demanant pel monitor.

- Quan l’obté, veu que la condició és true i acaba el loop.

Reentrant Lock

L’ús de synchronized és molt senzill i suficient en molts escenaris. Però hi ha una implementació, ReentrantLock, que permet les següents característiques addicionals:

- Intent de bloqueig: permet provar de bloquejar un lock sense haver d’esperar.

- Locks justos: permeten que els fils s’acabin executant en l’ordre en que han demanat el lock.

- Locks condicionals: permeten que un fil esperi fins que una condició es compleixi.

- Locks amb interrupció: permeten que un fil esperi fins que una condició es compleixi, però que es pugui interrompre.

Aquest podria ser el nostre fil per a l’exemple del comptador:

static class MyRunnable implements Runnable {

SharedObject so;

Lock lock;

MyRunnable(SharedObject so, Lock lock) {

this.so = so;

this.lock = lock;

}

void increment() {

try {

lock.lock();

so.counter ++;

} finally {

lock.unlock();

}

}

@Override

public void run() {

for (int i=0; i<1_000_000; i++) {

increment();

}

}

}

Com es pot veure, el mètode increment() fa servir un lock per a sincronitzar l’accés a la variable compartida. Això és el mateix que fer servir un mètode sincronitzat, però amb la diferència que podem fer servir el lock en un bloc de codi que pot llançar una excepció.

Llibreria Java concurrent

La llibreria java.util.concurrent conté classes útils quan fem concurrència:

- Executors: la interfície Executor permet representar un objecte que executa tasques. ExecutorService permet el processament asíncron, gestionant una cua i executant les tasques enviades segons la disponibilitat dels fils.

- Cues: ConcurrentLinkedQueue, BlockingQueue.

- Sincronitzadors: els clàssics semàfors (Semaphore), CountDownLatch.

- Col·leccions concurrents: per exemple,

ConcurrentHashMap, o els mètodes de CollectionssynchronizedMap(),synchronizedList()isynchronizedSet(). - Variables que permeten operacions atòmiques sense bloqueig al paquet java.util.concurrent.atomic: AtomicBoolean, AtomicInteger, etc.

Sempre és preferible utilitzar aquestes classes que els mètodes de sincronització wait/notify, perquè simplifiquen la programació. De la mateixa manera que és millor utilitzar executors i tasques que fils directament.

Tasques i executors

La majoria d’aplicacions concurrents s’organitzen mitjançant tasques. Una tasca realitza una feina concreta. D’aquesta forma, podem simplificar el disseny i el funcionament.

Veiem una possible solució per a la gestió de connexions a un servidor. Suposem que tenim un mètode, atendrePeticio(), que atén una petició web.

Execució seqüencial

try (ServerSocket socket = new ServerSocket(5508)) {

while (true) {

Socket client = socket.accept();

handleSession(client);

}

}

Un fil per cada petició

try (ServerSocket socket = new ServerSocket(5508)) {

while (true) {

Socket client = socket.accept();

Runnable tasca = new Runnable() {

@Override

public void run() {

handleSession(client);

}

};

new Thread(tasca).start();

}

}

Grup compartit de fils

int NFILS = 100;

Executor executor = Executors.newFixedThreadPool(NFILS);

try (ServerSocket socket = new ServerSocket(5508)) {

while (true) {

final Socket client = socket.accept();

Runnable tasca = new Runnable() {

public void run() {

handleSession(client);

}

};

executor.execute(tasca);

}

}

En aquesta solució hem introduït la interfície Executor:

public interface Executor {

void execute(Runnable command);

}

És un objecte que permet executar Runnables. Internament, el que fa és executar tasques de forma asíncrona, creant un fil per cada tasca en execució, i retornant el control al fil que crida el seu mètode execute. Les tasques poden tenir quatre estats:

- Creada

- Enviada

- Iniciada

- Completada

Els Executors es poden crear des de la classe amb mètodes estàtics Executors. Aquesta classe retorna una subclasse de Executor, l’ExecutorService. Aquesta subclasse usa el patró Thread Pool, que reutilitza un nombre màxim de fils entre una sèrie de tasques a una cua.

Un ExecutorService ha de parar-se sempre amb el mètode shutdown(), que para tots el fils del pool.

Tasques amb resultats

Algunes tasques retornen resultats. Per implementar-les, podem utilitzar les interfícies Callable i Future:

public interface Callable<V> {

V call() throws Exception;

}

public interface Future<V> {

boolean cancel(boolean mayInterruptIfRunning);

boolean isCancelled();

boolean isDone();

V get() throws InterruptedException, ExecutionException, CancellationException;

V get(long timeout, TimeUnit unit) throws InterruptedException, ExecutionException, CancellationException, TimeoutException;

}

Callable<V> permet executar la tasca i retornar un valor del tipus V. Per tal de poder executar-la, necessitem un ExecutorService. En particular, els seus dos mètodes:

Future<?> submit(Runnable task)<T> Future<T> submit(Callable<T> task)

Aquests permeten executar un Runnable / Callable i retornen un Future, que és un objecte que permet obtenir el resultat en diferit mitjançant el mètode get() (bloqueig) o get(long timeout, TimeUnit unit) (bloqueig per un temps).

També podem cancel·lar la tasca mitjançant cancel(boolean mayInterruptIfRunning): el paràmetre diu si es vol interrompre també si ja ha començat.

Els ExecutorService poden crear-se mitjançant la mateixa classe que hem vist abans, Executors.

A continuació, un exemple de funcionament. Com canvia l’execució si fem Executors.newFixedThreadPool(2)?

public class CallablePlay {

static final Logger logger = LoggerFactory.getLogger(CallablePlay.class);

public static void main(String[] args) {

ExecutorService executor = Executors.newFixedThreadPool(1); // <-- change this to 2

Future<String> f1 = executor.submit(new ToUpperCallable("hello"));

Future<String> f2 = executor.submit(new ToUpperCallable("world"));

try {

long millis = System.currentTimeMillis();

logger.info("main {} {} in millis: {}",

f1.get(), f2.get(), (System.currentTimeMillis() - millis));

} catch (InterruptedException | ExecutionException ex) {

logger.error(null, ex);

}

executor.shutdown();

}

private static final class ToUpperCallable implements Callable<String> {

private String word;

public ToUpperCallable(String word) {

this.word = word;

}

@Override

public String call() throws Exception {

String name = Thread.currentThread().getName();

logger.info("{} calling for {}", name, word);

Thread.sleep(2500);

String result = word.toUpperCase();

logger.info("{} result {} => {}", name, word, result);

return result;

}

}

}

A Java 7 es va introduir el framework fork/join.

A Java 8 es va introduir el CompletableFuture, que permet combinar futurs i gestionar millor els errors que es produeixen. Un exemple és l’ús del mètode complete per a completar un futur, en un altre fil:

CompletableFuture<String> cf = new CompletableFuture<>();

new Thread(() -> {

logger.info("sleeping...");

Threads.rest(2500);

logger.info("completing...");

cf.complete("hello!");

}, "writer").start();

new Thread(() -> {

try {

logger.info("getting result...");

String result = cf.get();

logger.info("result: {}", result);

} catch (InterruptedException | ExecutionException e) {

logger.error("Error getting result", e);

}

}, "reader").start();

A continuació es demostra una cadena d’etapes (stages) de CompletableFuture. Cada etapa transforma o consumeix el resultat, tancant finalment l’executor:

ExecutorService es = Executors.newCachedThreadPool();

CompletableFuture.supplyAsync(() -> { // Supplier

Threads.rest(250);

return "hello!";

}, es).thenApply(s -> { // Function

Threads.rest(250);

return s.toUpperCase();

}).thenAccept(s -> { // Consumer

Threads.rest(250);

logger.info("got {}", s);

}).thenRun(() -> { // Runnable

Threads.rest(250);

logger.info("done here!");

es.shutdown();

});

Pas de missatges

- Model de programació síncron i asíncron

- Comunicació asíncrona

- Gestió síncrona de peticions

- Gestió asíncrona de peticions

- Exemples

- Programació i sistemes reactius

El pas de missatges pot implementar-se:

- Dins d’un procés, mitjançant fils. Utilitzant buffers o cues, per exemple.

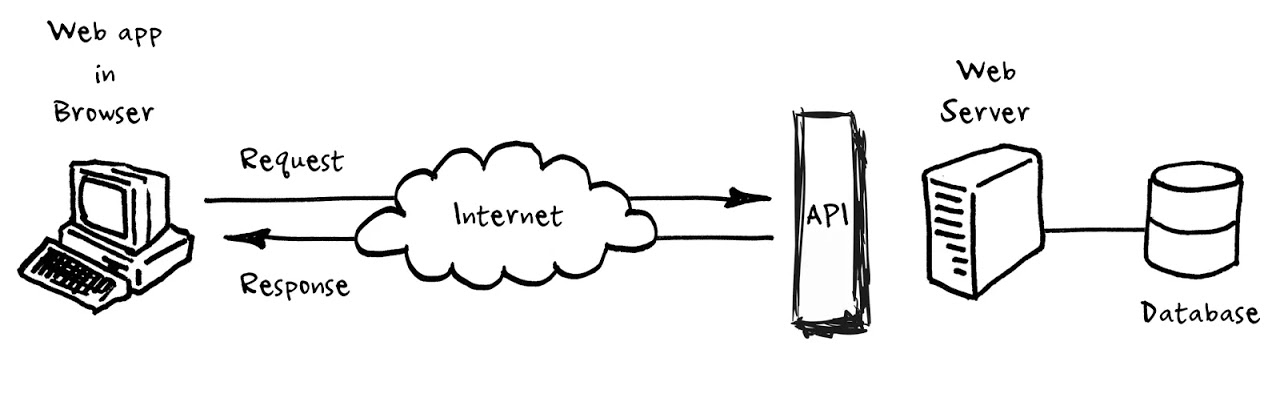

- Entre processos. Habitualment, es fa utilitzant el paradigma client/servidor i mitjançant xarxes. Un possible mecanisme és l’ús de sòcols, com es podrà veure a la UF Sòcols i serveis. En aquesta comunicació no hi ha compartició de dades mutables, però pot passar que múltiples clients accedeixin simultàniament a un mateix servidor.

En el diagrama pot veure’s una implementació entre processos.

Model de programació síncron i asíncron

La comunicació entre les dues parts es pot realitzar de forma síncrona o de forma asíncrona, segons hi hagi un bloqueig E/S (entrada/sortida).

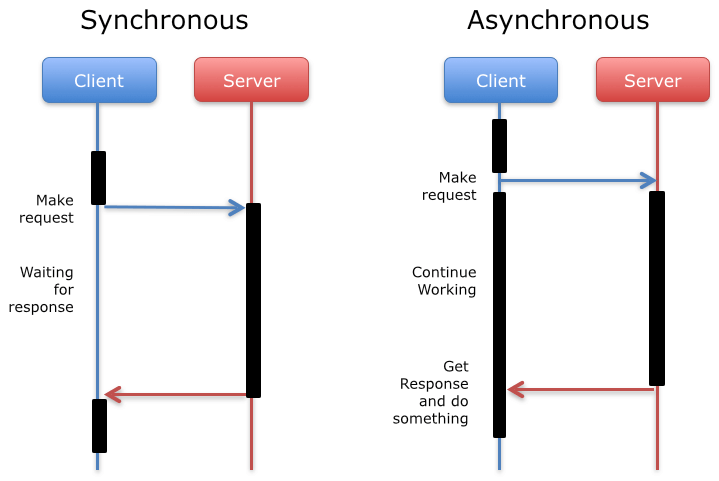

Comes pot veure al diagrama, en la forma síncrona el client espera la resposta del servidor (bloqueig E/S), i mentrestant no fa res. A la forma asíncrona envia la petició, continua treballant i en un moment donat rep la resposta (sense bloqueig E/S).

Quina forma és més convenient? Depèn de les circumstàncies. La forma síncrona és més fàcil d’implementar, però l’asíncrona permet millorar el rendiment del sistema introduint la concurrència.

Comunicació asíncrona

Les peticions asíncrones han de permetre al client conèixer el resultat a posteriori. Alguns solucions possibles:

- Cap: el client només pot saber com va anar fent una o diverses consultes posteriors (polling).

- Una crida de codi: quan acaba la petició, el servidor fa una crida al codi. Podria implementar-se mitjançant callbacks.

- Un missatge: quan acaba la petició, el servidor envia un missatge que pot rebre el client. Aquest missatge pot viatjar en diferents protocols, i se sol implementar mitjançant algun tipus de middleware. Habitualment, els missatges van a parar a cues, que després gestionen els servidors.

Gestió síncrona de peticions

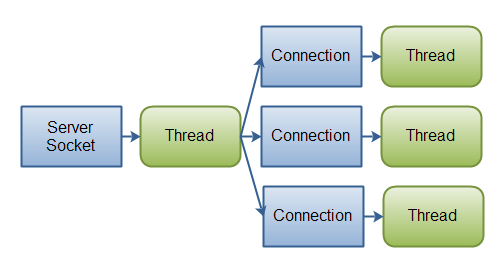

Quan utilitzem el model síncron (amb bloqueig), un sol fil no pot gestionar diverses peticions simultànies. Això vol dir que necessitem crear un fil per gestionar cada petició i retornar la resposta. En diem arquitectura basada en fils.

Habitualment, es limita el nombre de fils que es permeten gestionar simultàniament per evitar el consum excessiu de recursos.

Gestió asíncrona de peticions

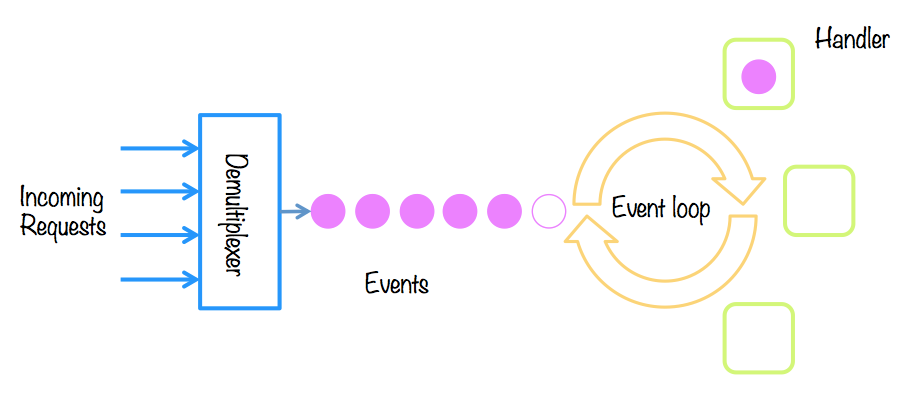

Es reprodueix el patró productor-consumidor: els productors són l’origen dels esdeveniments, i només saben que un ha ocorregut; mentre els consumidors necessiten saber que hi ha un nou esdeveniment, i l’han d’atendre (handle). En diem arquitectura basada en esdeveniments.

Algunes tècniques per implementar el servei:

- El patró reactor: les peticions es reben i es processen de forma síncrona, en un mateix fil. Funciona si les peticions es processen ràpidament.

- El patró proactor: les peticions es reben i es divideix el processament asíncronament, introduint concurrència.

A Java tenim Vert.x, una implementació multireactor (amb N bucles d’esdeveniments).

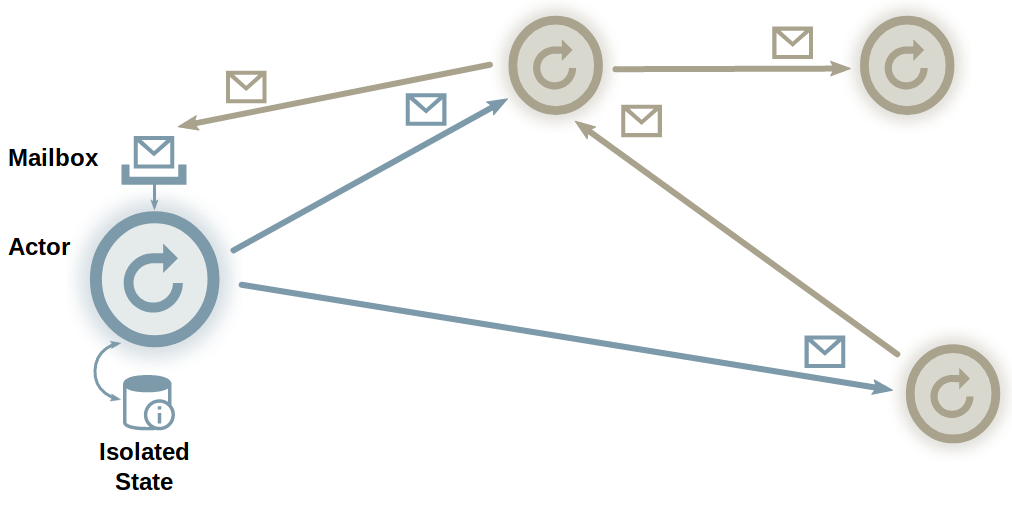

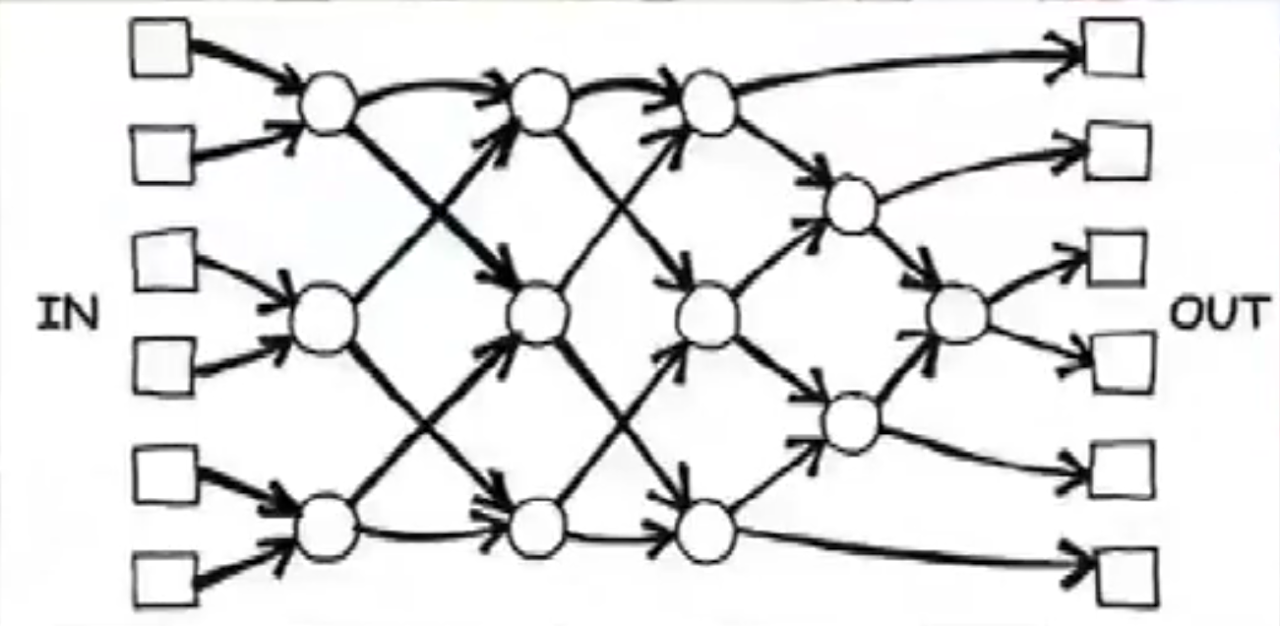

Una altra tècnica per a gestionar peticions asíncrones és el model d’actors. Aquest model permet crear programes concurrents utilitzant actors no concurrents.

- Un actor és una unitat de computació lleugera i desacoblada.

- Els actors tenen estat, però no poden accedir a l’estat d’altres actors.

- Es pot comunicar amb altres actors mitjançant missatges asíncrons immutables.

- L’actor processa els missatges seqüencialment, evitant contenció sobre l’estat.

- Els missatges poden estar distribuïts per la xarxa.

- No es pressuposa cap ordre concret en els missatges.

A Java, tenim un exemple de llibreria: Akka.

Exemples

Una forma d’implementar-lo és passar missatges entre fils mitjançant l’ús d’una cua sincronitzada. Pot haver-hi un o més productors i un o més consumidors. La cua ha de ser thread-safe. A Java, les implementacions de BlockingQueue, ArrayBlockingQueue i LinkedBlockingQueue, en són exemples. Els objectes a aquestes cues han de ser d’un tipus immutable.

Buffer asíncron (cua)

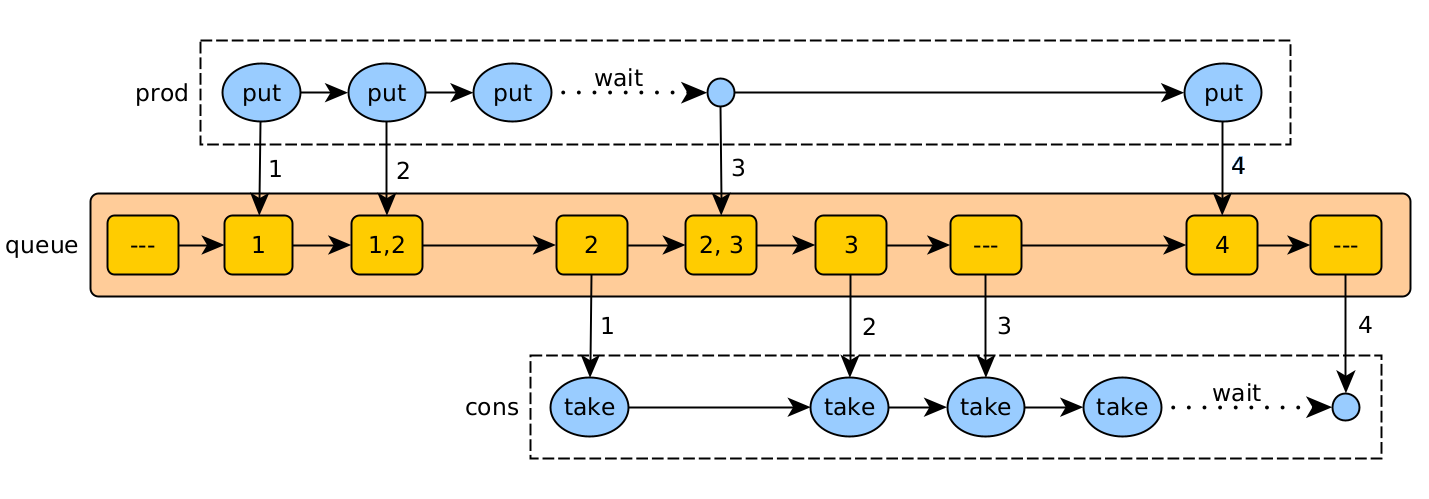

En aquest exemple, un fil productor envia treballs (1, 2, 3, 4) a un fil consumidor mitjançant una cua thread-safe. La mida màxima de la cua es 2.

Les accions són:

- put (prod): afegir un treball, esperant si no hi ha prou espai.

- take (cons): llegir un treball per processar-lo, i esperar si no hi ha cap.

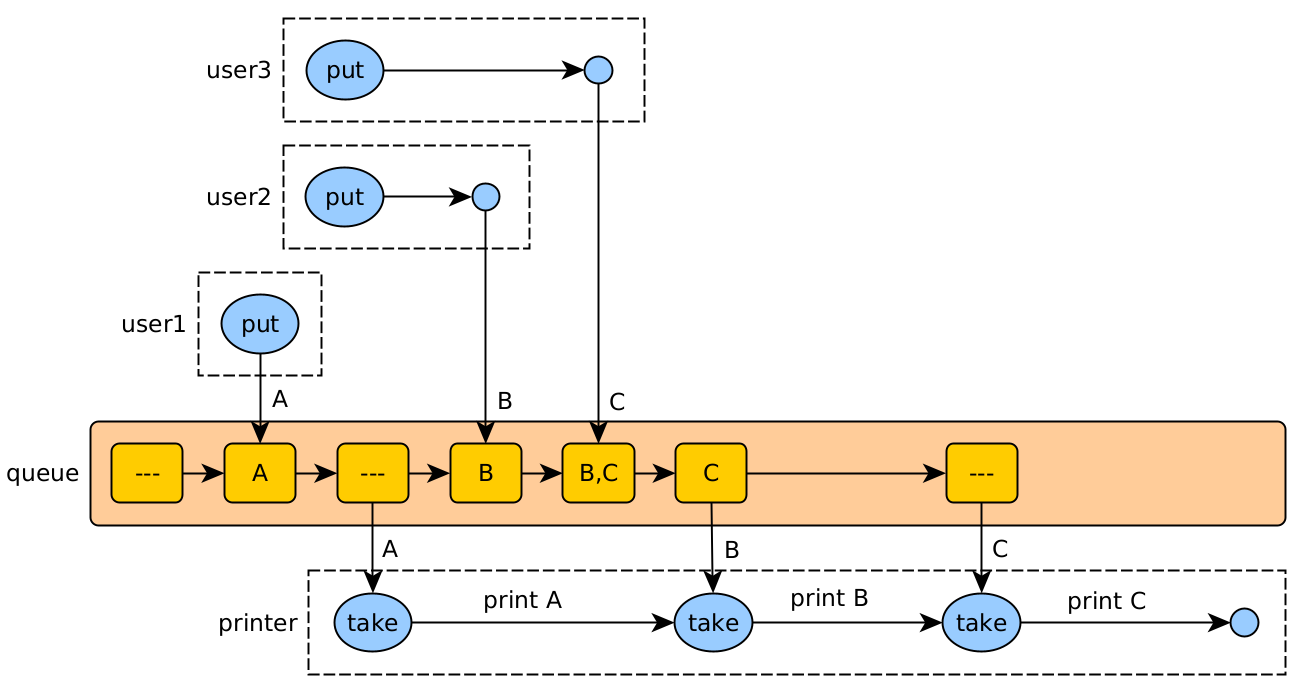

Flux de crides de la impressora asíncrona

De vegades, les peticions fan referència a un recurs compartit que no permet el seu ús per més d’un client alhora. En aquests casos, es pot implementar una cua que gestioni les peticions de forma asíncrona:

- El client realitza la petició asíncrona, i més endavant pot rebre la resposta o confirmació de la petició.

- El servidor registra la petició en una cua, que va atenent per ordre a un fil independent.

La impressora és un únic fil (servidor) que va llegint els treballs afegits a la cua per diferents usuaris (fils), i atenent-los.

També podríem tenir més d’una cua, si hi ha la possibilitat de tenir més d’un punt per atendre les peticions (diverses impressores).

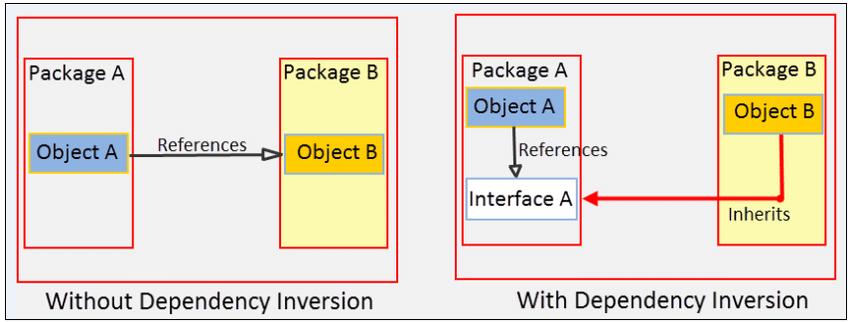

Programació i sistemes reactius

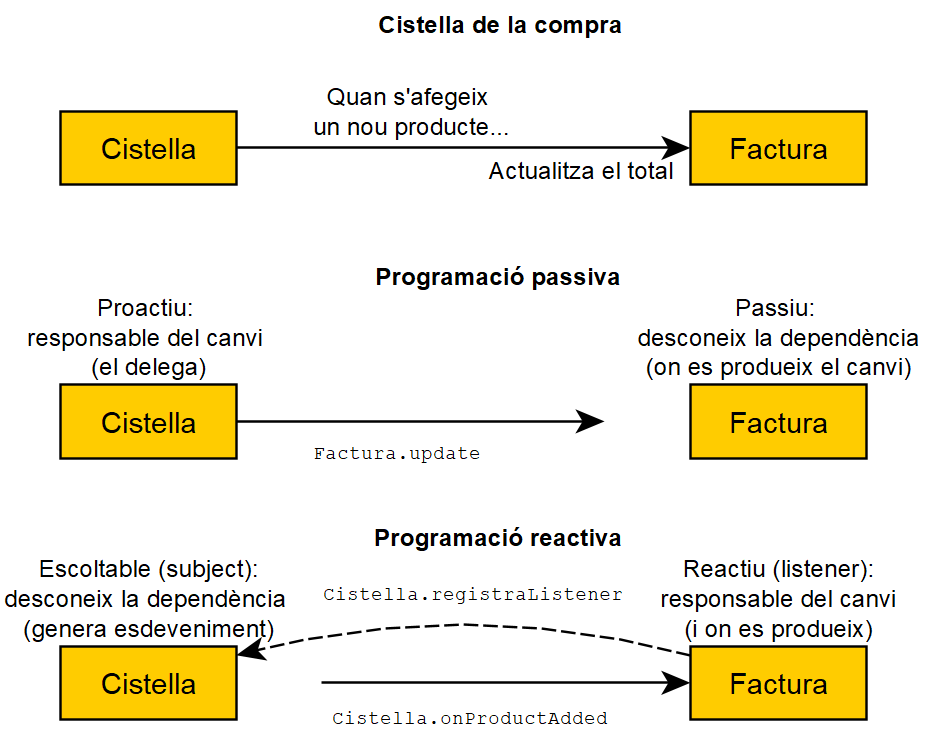

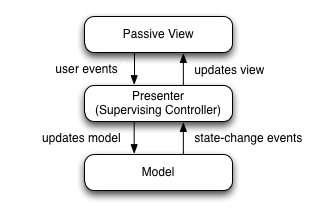

La programació passiva és la tradicional als dissenys OO: un mòdul delega en un altre per a produir un canvi al model.

L’alternativa plantejada es diu programació reactiva, on utilitzem callbacks per a invertir la responsabilitat.

El terme “reactiu” s’utilitza en dos contextos:

- La programació reactiva està basada en esdeveniments (event-driven). Un esdeveniment permet el registre de diversos observadors. Habitualment funciona de forma local.

- Els sistemes reactius generalment es basen en missatges (message-driven) amb un únic destí. Es corresponen més sovint a processos distribuïts que es comuniquen a través d’una xarxa, potser com a microserveis que cooperen.

En l’exemple de la cistella de la compra, podem veure com implementar-ho amb programació passiva i reactiva:

- Amb passiva, la cistella actualitza la factura. Per tant, la cistella és la responsable del canvi i depèn de la factura.

- Amb reactiva, la factura rep un esdeveniment de producte afegit i s’actualiza a si mateixa. La factura depèn de la cistella, ja que li ha de dir que vol sentir els seus esdeveniments.

Pros i contres:

- La programació reactiva permet entendre millor com funciona un mòdul: només cal mirar al seu codi, ja que és responsable d’ell mateix. Amb la passiva és més difícil, ja que cal mirar-se els altres mòduls que el modifiquen.

- Per altra banda, amb programació passiva és més fàcil entendre a quins mòduls afecta un: mirant quines referències es fan. Amb programació reactiva cal mirar-se quins mòduls generen un cert esdeveniment.

La programació reactiva és asíncrona i sense bloqueig. Els fils que busquen recursos compartits no bloquegen l’espera que el recurs estigui disponible. En el seu lloc, continuen la seva execució i són notificats després quan el servei s’ha completat.

Les extensions reactives permeten que llenguatges imperatius, com Java, puguin implementar programació reactiva. Ho fan utilitzant programació asíncrona i streams observables, que emeten tres tipus d’esdeveniments als seus subscriptors: següent, error i completat.

Des de Java 9 s’han definit els streams reactius utilitzant el patró Publish-Subscribe (molt semblant al patró observador) mitjançant les interfícies Flow. Les implementacions més utilitzades són Project Reactor (p. ex. Spring WebFlux) i RxJava (p. ex. Android).

Per altra banda, un sistema reactiu és un estil d’arquitectura que permet que diverses aplicacions puguin comportar-se com una sola, reaccionant al seu entorn, mantenint-se al corrent els uns dels altres, i permetent la seva elasticitat, resiliència i responsivitat basats (habitualment) en cues de missatges dirigits a receptors concrets (vegeu el Reactive Manifesto). Una aplicació dels sistemes reactius són els microserveis.

Tant els patrons reactor/proactor com el model d’actors permeten implementar sistemes reactius.

Sòcols i serveis

Referències

- OSI Model

- HTTP (Mozilla)

- HttpURLConnection

- reqbin.com

- A guide to Java sockets

- Do a Simple HTTP Request in Java

- Core Java Networking (eugenp)

- Read an InputStream using the Java Server Socket

- REST vs Websockets (baeldung)

- A Guide to the Java API for WebSocket (baeldung)

- All About Sockets (The Java Tutorials)

- SSL Handshake Failures (baeldung)

- HTTP: The Protocol Every Web Developer Must Know (part 1)

- HTTP: The Protocol Every Web Developer Must Know (part 2)

- REST API Tutorial

- Blocking I/O and non-blocking I/O

- A Guide to NIO2 Asynchronous Socket Channel

- Java NIO Tutorial (Jenkov)

- How Single-Page Applications Work

- What Is a Single Page Application and Why Do People Like Them so Much?

- Guía práctica para la publicación de Datos Abiertos usando APIs

- Local-first software

Protocols

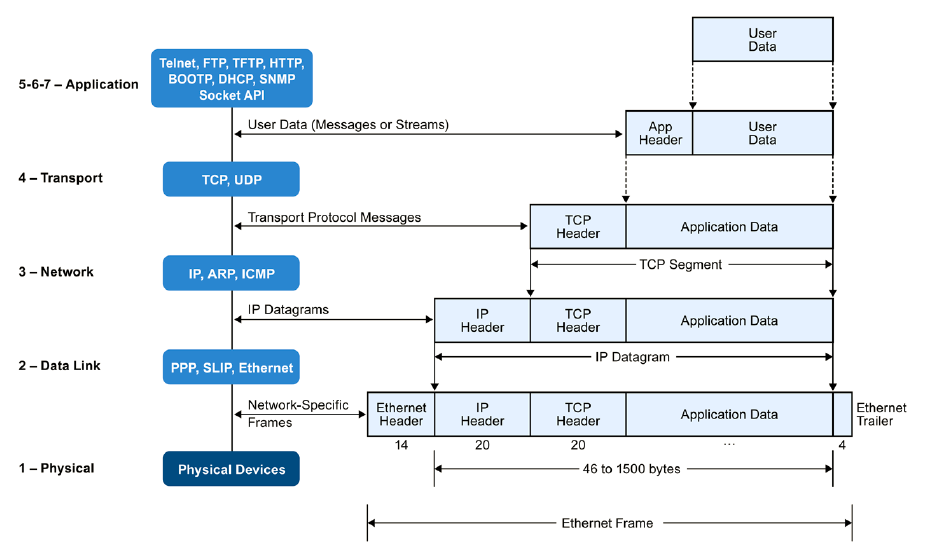

Els protocols d’Internet tenen més d’un model. El model OSI ens dona una organització per capes:

- Física: transmissió i recepció de bits sobre el mitjà físic.

- Enllaç: transmissió fiable de trames entre dos nodes. PPP.

- Xarxa: transmissió de paquets sobre una xarxa multi-node, amb adreçament, encaminament i control de tràfic. IP.

- Transport: transmissió de segments de dades entre punts d’una xarxa. TCP, UDP.

- Sessió: gestió de sessions.

- Presentació: traducció dels protocols cap a una aplicació. MIME, SSL.

- Aplicació: APIs d’alt nivell. HTTP, Websockets.

Com a programadors, podem involucrar-nos a diferents nivells del model:

- Construint protocols basats en TCP, UDP mitjançant Java Sockets (nivell 4 i mig).

- Accedint a aplicacions web HTTP (nivell 7), implementades als ports 80 o 443 (segur).

Els protocols de nivell 4 i mig estàndards es poden veure a aquesta llista.

IP versió 4

Les adreces IPv4 utilitzen 32 bits, i tenen rangs assignats a diferents propòsits:

- Classe A: de 1.x.x.x a 127.x.x.x (subnet mask 255.0.0.0). El rang 127.x.x.x està reservat per al loopback.

- Classe B: de 128.0.x.x a 191.255.x.x (subnet mask 255.255.0.0).

- Classe C: de 192.0.0.x a 223.255.255.x (subnet mask 255.255.255.0).

- Classe D: de 224.0.0.0 a 239.255.255.255. Reservades per a multicasting.

- Classe E: de 240.0.0.0 a 255.255.255.254. Reservades per a recerca.

D’aquestes, es consideren IP privades:

- 10.0.0.0 a 10.255.255.255

- 172.16.0.0 a 172.31.255.255

- 192.168.0.0 a 192.168.255.255

Aquests són els tipus d’encaminaments disponibles:

Unicast: adreces de classe A, B i C. Transport TCP i UDP.

Broadcast: Adreça del host (sufix) amb tot 1’s. Transport UDP. No travessen els encaminadors, i les reben totes les màquines. No disponible a IPv6.

Multicast: adreces de classe D. Transport UDP. Una màquina ha d’escoltar per rebre la comunicació. Disponible a xarxes locals.

IP versió 6

IPv6 és la versió 6 del Protocol d’Internet (IP), i està dissenyat per substituir l’actual IPv4 a internet, però encara no està suportat completament. Les adreces utilitzen 128 bits, que es mostren en grups de 4 dígits hexa.

xxxx:xxxx:xxxx:xxxx:xxxx:xxxx:xxxx:xxxx

IPv6 no té classes. Quan es fa subxarxes, la notació /NN indica la longitud del prefix de xarxa. Per exemple:

2001:0db8:1234::/64

La notació :: indica un o més grups de valor 0. Només hi pot haver un :: en una adreça.

El loopback es representa com ::1/128 o, simplement, ::1.

Els tipus d’encaminament d’IPv6 són unicast, multicast i anycast (el tipus broadcast no existeix a IPv6). Anycast permet enviar un missatge a un group on només contesta un, el més proper.

Disseny de protocols

Classificació dels protocols

Els protocols es poden classificar en base a diversos criteris:

- La direcció:

- Unidireccional: UDP, SSE

- Bidireccional: WebSocket, QUIC

- El patró de comunicació:

- Petició–Resposta: HTTP, gRPC

- Pub/Sub: Kafka, MQTT

- Streaming: WebSocket, SSE

- Negociació: TLS, SSH

- El transport:

- TCP: HTTP, SSH

- UDP: DNS, VoIP

- El format:

- Text: JSON, XML

- Binari: Protobuf, AMQP

- Si tenen estat:

- Sense estat: REST, DNS

- Amb estat: WebSocket, FTP

- La seguretat:

- Sense xifrar: HTTP

- Xifrat: HTTPS, SSH

Introducció al disseny

Els protocols regeixen la comunicació entre dues parts. Un protocol ben dissenyat garanteix fiabilitat, claredat i extensibilitat. El disseny del protocol implica definir:

- Format del missatge: Estructura de peticions i respostes.

- Flux de treball: seqüència d’interaccions entre les dues parts.

- Conversió de flux de bytes: codificació i descodificació de missatges per a la transmissió.

En la comunicació de xarxa, les dades es transmeten com un flux de bytes. Sense una estructura definida, és impossible determinar on acaba un missatge i on comença el següent, o com interpretar el contingut d’un missatge. Un protocol preveu:

- Límits: marcadors per identificar l’inici i el final dels missatges.

- Regles de descodificació: instruccions per interpretar el flux de bytes en brut en dades significatives.

- Coherència: un format estandarditzat per a la comunicació.

Per exemple, un client que envia una sol·licitud d’inici de sessió i un servidor que respon ha d’acordar com codificar el nom d’usuari, la contrasenya i l’estat de resposta en un flux de bytes, així com com tornar-lo a descodificar.

Objectius:

- Estandarditzar la comunicació entre dues parts.

- Minimitzar errors i ambigüitats.

- Admet camps de dades flexibles i de longitud variable.

Disseny d’alt nivell

Abans de dissenyar el protocol, identificar:

- El servei que s’ha d’implementar (p. ex., transferència de fitxers, autenticació o xat).

- Tipus de peticions i respostes necessàries.

A continuació, descriure la interacció típica:

- Configuració de la connexió: com dues parts estableixen una connexió.

- Intercanvi petició-resposta: defineix la seqüència de missatges.

- Desactivació de la connexió: defineix com acaba la connexió.

Un missatge del protocol pot tenir:

- Capçalera, metadades que defineixen el tipus de missatge i què esperem.

- Càrrega útil o payload, amb el contingut real del missatge. Poden contenir camps de mida fixa o mida variable (amb prefixos de longitud).

Exemple de missatge:

| Camp | Descripció |

|---|---|

| Longitud de la capçalera | Mida fixa, indica la mida de la capçalera (en bytes). |

| Tipus de missatge | Especifica el tipus de missatge (p. ex., sol·licitud, resposta). |

| Longitud de càrrega útil | Mida de la càrrega útil en bytes. |

| Càrrega útil | Camp de mida variable que conté les dades reals. |

Exemple de capçalera:

- Longitud de la capçalera: 2 bytes

- Tipus de missatge: 1 byte (p. ex., 0x01 per a la sol·licitud, 0x02 per a la resposta)

- Longitud de càrrega útil: 4 bytes (sencer big-endian)

Exemple de payload per a inici de sessió:

| Camp | Tipus | Llargada |

|---|---|---|

| Longitud del nom d’usuari | Sencer | 2 bytes |

| Nom d’usuari | Cadena | Variable |

| Longitud de la contrasenya | Sencer | 2 bytes |

| Contrasenya | Cadena | Variable |

El procés de codificació i decodificació transforma dades de l’àmbit de la programació en fluxos de dades en fluxos de bytes, i de nou a dades. Aquest procés s’anomena també serialització i deserialització, i hauria de ser independent del llenguatge de programació, el sistema operatiu o altres condicionants.

Disseny de protocols per a TCP i UDP

En implementar un protocol, és essencial entendre les característiques específiques del protocol de transport subjacent.

TCP (Protocol de control de transmissió)

TCP proporciona un lliurament fiable, ordenat i verificat d’errors de fluxos de dades.

Característiques clau de TCP

- Fiabilitat: TCP assegura que tots els missatges s’entreguen sense pèrdua.

- Preservació de l’ordre: les dades arriben al receptor en el mateix ordre en què es van enviar.

- Orientat al flux: els missatges es transmeten com un flux continu de bytes, que requereixen mecanismes addicionals per definir els límits del missatge.

Consideracions sobre l’estructura del missatge

- Límits explícits: cal utilitzar prefixos de longitud o delimitadors per separar els missatges dins del flux.

- Reassemblatge de fragments: els missatges han d’enviar-se en unitats de transmissió i, internament, l’API de Java s’encarrega de l’assemblatge i reassemblatge quan superen la mida d’una unitat.

- Amb estat: la comunicació TCP és orientada a connexió i manté l’estat entre client i servidor durant tota la sessió. Això permet assegurar l’ordre dels missatges i detectar la pèrdua o duplicació de dades.

UDP (Protocol de datagrama d’usuari)

UDP és un protocol sense connexió que ofereix una comunicació més ràpida però menys fiable.

Característiques clau d’UDP

- Sense fiabilitat: es poden perdre missatges o lliurar-se fora de servei sense cap retransmissió automàtica.

- Sense connexió: no cal establir una connexió abans d’enviar dades, per la qual cosa és més ràpid que TCP.

- Sense preservació de l’ordre: UDP no garanteix que els missatges arribin en el mateix ordre en què es van enviar.

- Baixa sobrecàrrega: les capçaleres UDP són més petites en comparació amb les capçaleres TCP, la qual cosa la fa més eficient pel que fa a l’ús de l’ample de banda.

Consideracions sobre l’estructura del missatge:

- Sense límits incorporats: com que UDP està orientat a missatges, cada paquet UDP és un sol missatge. Si s’han enviar diversos missatges en un paquet, cal definir límits a nivell d’aplicació (p. ex., utilitzant delimitadors o prefixos de longitud).

- Límits de mida dels missatges: els paquets UDP solen tenir una mida limitada (normalment uns 65.535 bytes), però pot ser que es necessiti fragmentació a nivell d’aplicació per a missatges més grans.

- Sense estat: la comunicació amb UDP és connectionless, és a dir, no es manté cap estat entre els extrems de la comunicació. Cada missatge (datagrama) s’envia de manera independent, i no hi ha garantia d’entrega, ni d’ordenació, ni de detecció de duplicats. És responsabilitat de l’aplicació, si cal, implementar mecanismes de control o fiabilitat.

Escollir entre TCP i UDP

Quan es dissenya un protocol, l’elecció entre TCP i UDP depèn de diversos factors:

- Requisits de fiabilitat: si s’ha de garantir l’entrega de missatges (per exemple, transaccions financeres, transferències de fitxers), TCP és la millor opció a causa de les seves capacitats de verificació d’errors i retransmissió.

- Necessitats de rendiment: si una latència baixa és crítica i es pot tolerar la pèrdua ocasional de missatges (per exemple, la transmissió de veu o de vídeo en temps real), UDP pot ser una millor opció a causa de la seva menor sobrecàrrega i de la seva entrega més ràpida.

- Mida i freqüència del missatge: per a protocols amb missatges grans i poc freqüents (p. ex., transferència de fitxers), el disseny orientat al flux de TCP funciona bé. Per a missatges més petits i freqüents (per exemple, consultes DNS), la senzillesa i l’eficiència d’UDP són avantatjoses.

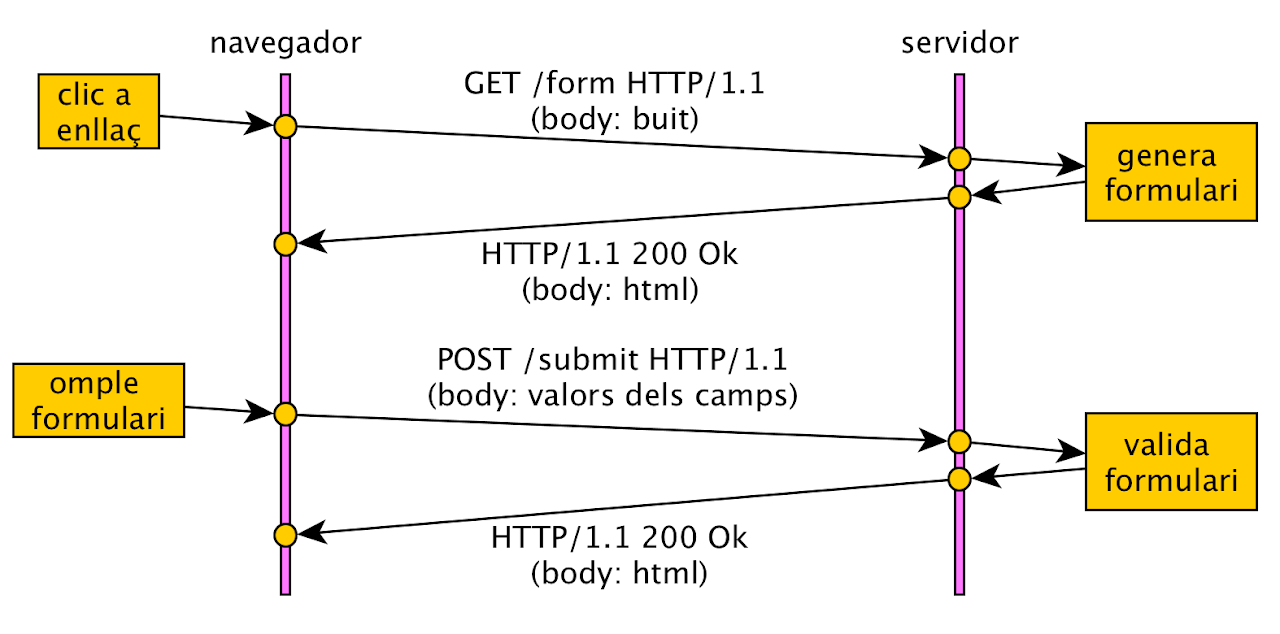

Protocol HTTP

HTTP és un protocol de nivell aplicació per a sistemes col·laboratius i distribuïts. És el component principal de la web, gràcies a l’ús de documents d’hipertext. HTTP/1.1, la versió actual, està implementat mitjançant TCP al transport. La versió 2 ja està estandaritzada, i la 3 funcionarà sobre UDP.

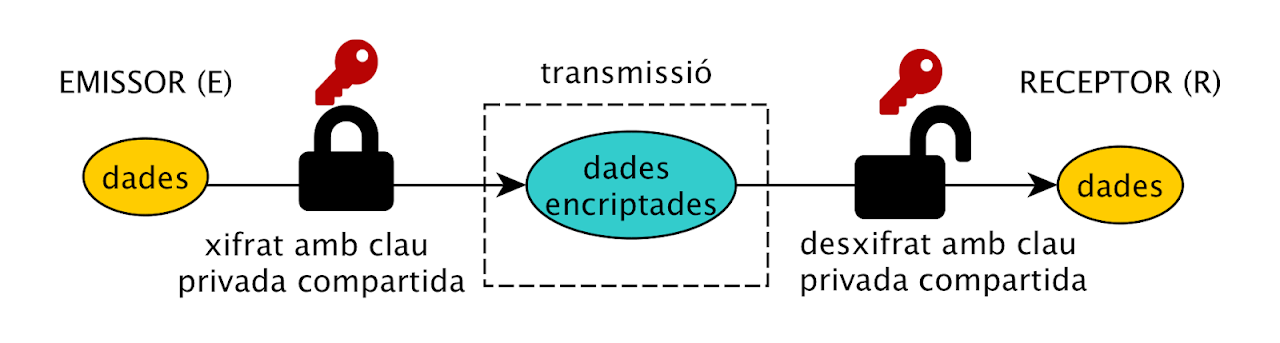

La versió segura d’HTTP es diu HTTPS, o també HTTP sobre TLS, el protocol criptogràfic per a la transmissió segura.

Sessió

Una sessió és una seqüència de peticions/respostes. Comença mitjançant l’establiment d’una connexió TCP a un port d’un servidor (habitualment 80). El servidor contesta habitualment amb un codi, del tipus “HTTP/1.1 200 OK”, i amb un cos, que normalment conté el recurs demanat.

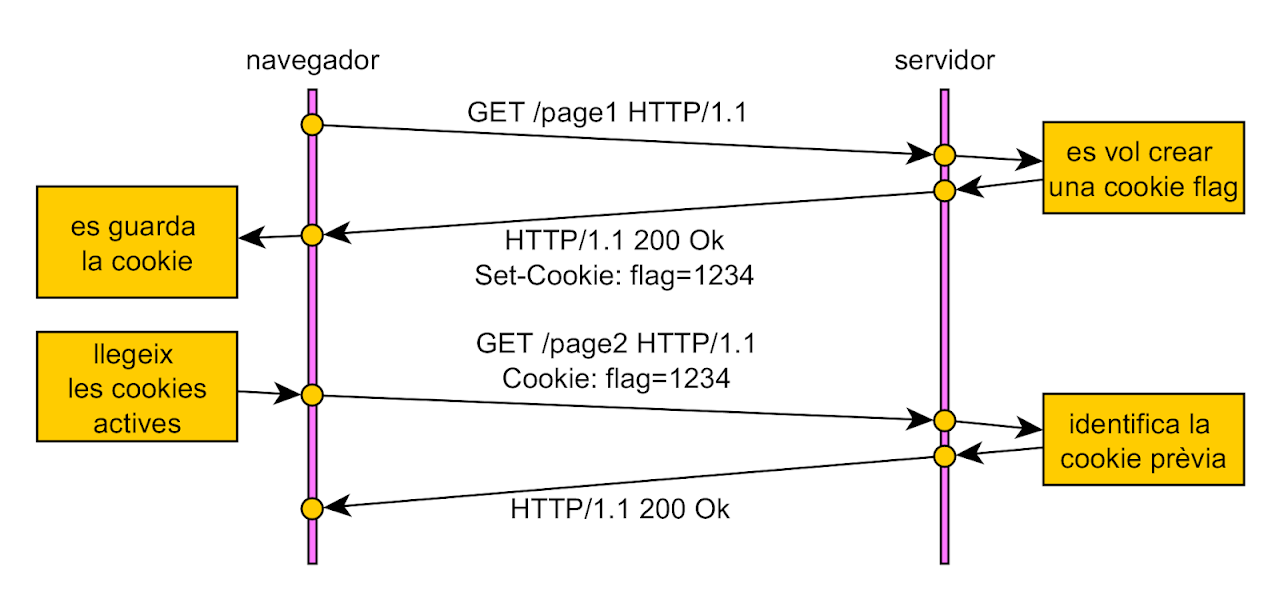

HTTP es un protocol sense estat, tot i que algunes aplicacions utilitzen mecanismes per emmagatzemar informació. Per exemple, les cookies.

Missatges

Una petició conté, habitualment:

- Una línia de petició, amb un mètode. Exemple: GET /images/logo.png HTTP/1.1

- Camps de la capçalera de la petició. Exemple: Accept-Language: ca

- Una línia buida.

- Un cos opcional. Exemple: per fer un POST.

Mètodes de petició:

- GET: el mètode habitual per obtenir un recurs. No té cos.

- POST: el mètode utilitzat per enviar un cos al servidor. S’utilitza als formularis.

- PUT, DELETE, TRACE, OPTIONS, CONNECT, PATCH son altres mètodes utilitzats.

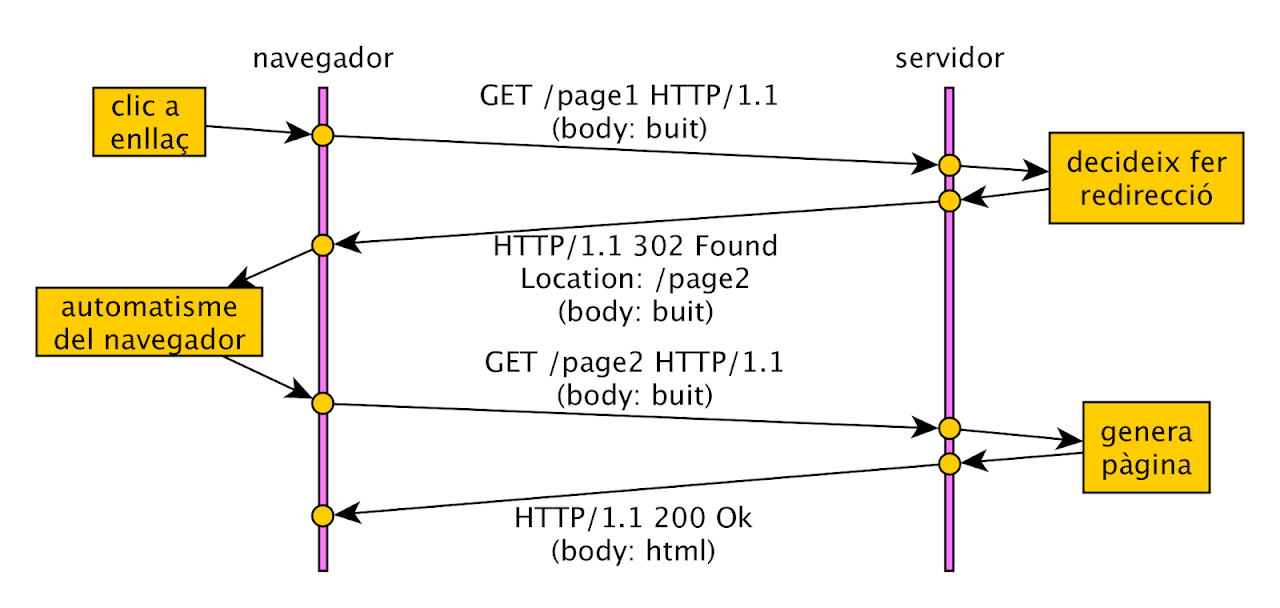

Una resposta conté:

- Una línia d’estat. Exemple: HTTP/1.1 200 OK.

- Camps de la capçalera de la resposta. Exemple: Content-Type: text/html

- Una línia buida.

- Un cos opcional. Exemple: per a un GET, el contingut requerit.

Els codis d’estat poden ser del tipus:

- Informació (1XX).

- Èxit (2XX). Exemple: 200 OK.

- Redirecció (3XX). Exemple: 301 Moved Permanently.

- Error de client (4XX). Exemple: 404 Not Found.

- Error de servidor (5XX). Exemple: 500 Internal Server Error.

Podem utilitzar el programa telnet per conectar-nos a un servidor web HTTP i enviar una comanda GET.

$ telnet maripili.es 80

Trying 217.160.0.165...

Connected to maripili.es.

Escape character is '^]'.

GET / HTTP/1.0

Host: maripili.es

Això provoca la resposta del servidor:

HTTP/1.1 200 OK

Content-Type: text/html; charset=UTF-8

Connection: close

Date: Wed, 16 Feb 2022 08:12:31 GMT

Server: Apache

<!DOCTYPE html>

<html lang="es">

...

</html>

Connection closed by foreign host.

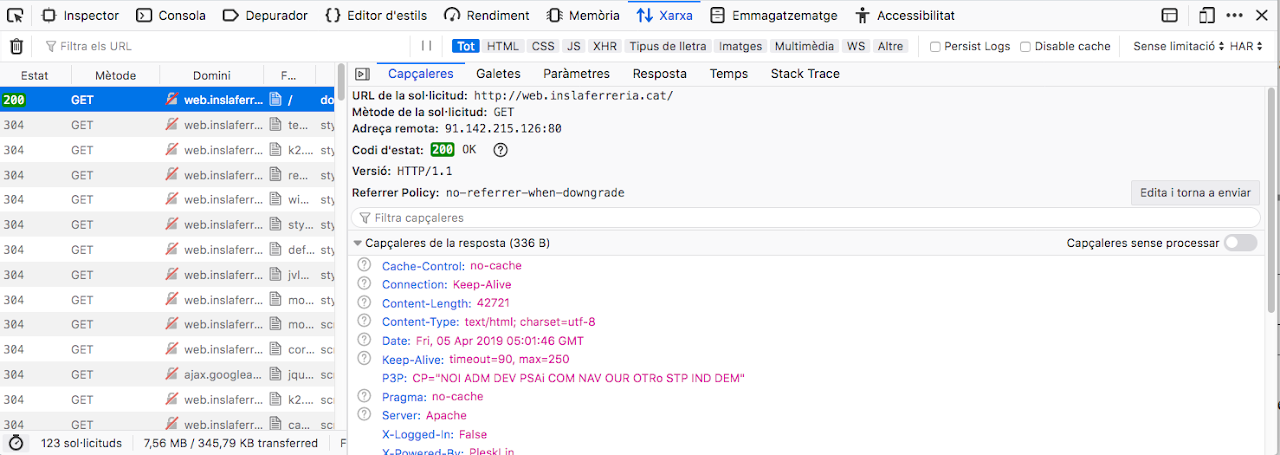

Eines

Tenim tres eines per depurar protocols HTTP: netcat, curl i l’inspector dels navegadors.

Netcat permet connectar-se a un port i fer una conversa, utilitzant les canonades. Si s’indica -u utilitza UDP, si no, TCP. Per exemple, per a accedir al servei echo de la nostra màquina:

nc localhost 7

CURL permet obtenir la resposta d’una URL a la xarxa.

$ curl -I http://maripili.es

(GET, veure headers)

HTTP/1.1 200 OK

Date: Fri, 05 Apr 2019 05:03:23 GMT

Server: Apache

X-Logged-In: False

P3P: CP="NOI ADM DEV PSAi COM NAV OUR OTRo STP IND DEM"

Cache-Control: no-cache

Pragma: no-cache

Set-Cookie: 4af180c8954a0d5a1965b5b1b23ccbc5=pc1jg8f5kqigd71iec5a5lm7k5; path=/

X-Powered-By: PleskLin

Content-Type: text/html; charset=utf-8

$ curl http://maripili.es

(GET, contingut de la pàgina web)

$ curl -v http://maripili.es

(GET, headers i contingut)

$ curl -d "key1=val1&key2=val2" http://maripili.es/contacto/

(POST)

Implementació a Java

URL i HttpURLConnection

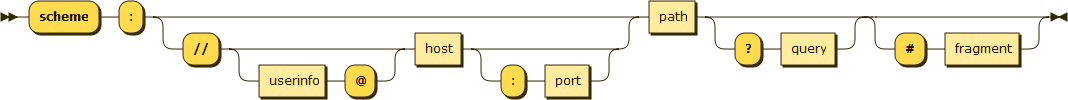

La classe URL fa referència a un recurs a la web. Un recurs genèric pot tenir la següent forma.

Veiem un exemple per al protocol HTTP:

https://www.example.com/test?key1=value1&key2=value2

En aquest cas, tenim que:

- l’esquema és https

- el host és www.example.com

- el port és 80, però no s’indica, ja que és el valor per defecte al protocol HTTP

- el camí (path) és test

- la query és key1=value1&key2=value2

A Java es pot construir una URL amb:

URL url = new URL(String spec)

Un cop fet això, podem accedir a cada part de l’URL amb els mètodes getHost(), getPath(), getPort(), getProtocol(), getQuery(), etc.

Els dos mètodes més importants per interactuar amb l’URL són:

URLConnection openConnection(): retorna una connexió al recurs remot.InputStream openStream(): retorna un InputStream per a llegir el recurs remot.

La classe URLConnection és abstracta, i si hem accedir a un recurs HTTP llavors l’objecte serà una instància de HttpURLConnection.

openStream

Per llegir una pàgina web que es trobi a l’URL d’una cadena anomenada urlText, podem fer:

URL url = new URL(urlText);

BufferedReader in = new BufferedReader(new InputStreamReader(url.openStream()));

Per llegir un arxiu:

BufferedInputStream in = new BufferedInputStream(new URL(urlText).openStream());

openConnection

Amb openConnection podem accedir als mètodes del protocol HTTP i els codis d’estat que es retornen o el tipus de contingut.

Aquest és un mètode GET:

URL url = new URL(urlText);

HttpURLConnection httpConn = ((HttpURLConnection) url.openConnection());

httpConn.setRequestMethod("GET"); // opcional: GET és el mètode per defecte

int responseCode = httpConn.getResponseCode();

String contentType = httpConn.getContentType();

BufferedReader in = new BufferedReader(new InputStreamReader(httpConn.getInputStream()));

// falta llegir in: resposta del servidor

Aquest és un mètode POST:

URL url = new URL(urlText);

HttpURLConnection httpConn = ((HttpURLConnection) url.openConnection());

httpConn.setRequestMethod("POST");

httpConn.setDoOutput(true);

OutputStreamWriter out = new OutputStreamWriter(httpConn.getOutputStream());

out.write("propietat1=valor1&propietat2=valor2"); // valors dels paràmetres del POST

out.close();

int responseCode = httpConn.getResponseCode();

String contentType = httpConn.getContentType();

BufferedReader in = new BufferedReader(new InputStreamReader(httpConn.getInputStream()));

// falta llegir in: resposta del servidor

Sòcols

- TCP i UDP

- Protocol exemple: ECHO

- Protocol exemple: SMTP

- Comunicació TCP

- Comunicació UDP

- Timeouts

- Tancament

- Comunicació asíncrona

Un sòcol és un enllaç de doble sentit que permet comunicar dos programaris que són a la xarxa.

Aquests dos programaris fan dues funcions: la del client i la del servidor. El servidor proveeix algun servei des d’un lloc conegut (adreça IP + port), i el client accedeix a aquest servei. Aquest servei ha d’implementar un protocol ben definit, sigui un estàndard o un de dissenyat a mida.

Els números de ports són:

- El rang 0 a 1023 són els ports coneguts (well-known) o de sistema. En Linux, cal ser administrador per tenir un servei en aquests ports.

- El rang 1024-49151 són els ports registrats, assignats per IANA.

- El rang 49152–65535 són ports dinàmics o privats, o de vida curta.

Com que els dos programaris treballen en l’àmbit del protocol, al codi dels dos programaris no hi ha dependències mútues. Però és habitual que qui implementa el protocol proveeixi d’una llibreria de client per poder accedir al servei. Això permet reduir el codi que un client ha d’escriure, i assegura que utilitzarà correctament el protocol. A Java, la llibreria de client es materialitza mitjançant un arxiu jar i una documentació d’ús.

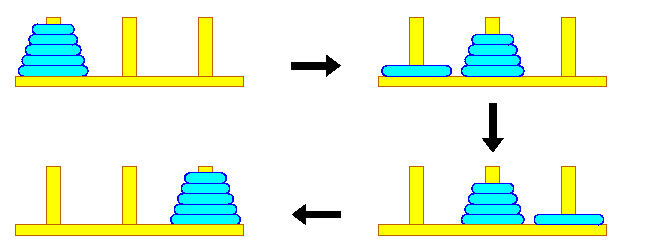

TCP i UDP

Es poden utilitzar els protocols TCP o UDP. TCP està orientat a connexió, i UDP no. Això vol dir que TCP requereix un pas previ de connexió entre el client i el servidor per tal de comunicar-se. Un cop establerta la connexió, TCP garanteix que les dades arribin a l’altre extrem o indicarà que s’ha produït un error.

En general, els paquets que han de passar en l’ordre correcte, sense pèrdues, utilitzen TCP, mentre que els serveis en temps real on els paquets posteriors són més importants que els paquets més antics utilitzen UDP. Per exemple, la transferència d’arxius requereix una precisió màxima, de manera que normalment es fa mitjançant TCP, i la conferència d’àudio es fa freqüentment a través d’UDP, en què pot ser que no es notin les interrupcions momentànies.

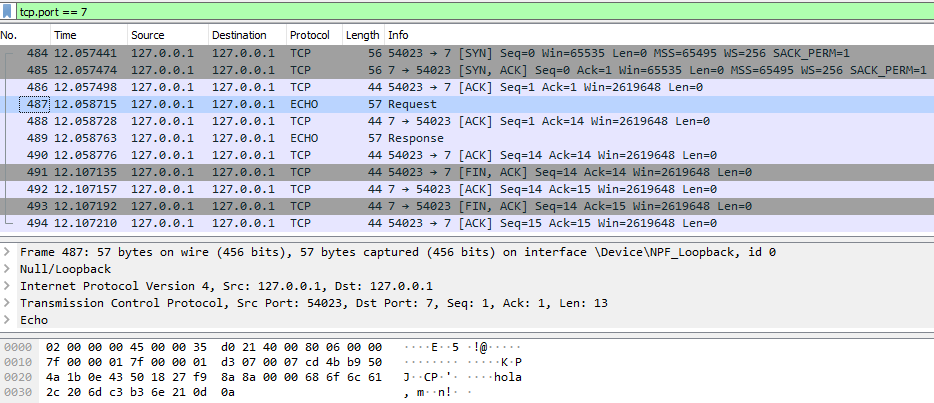

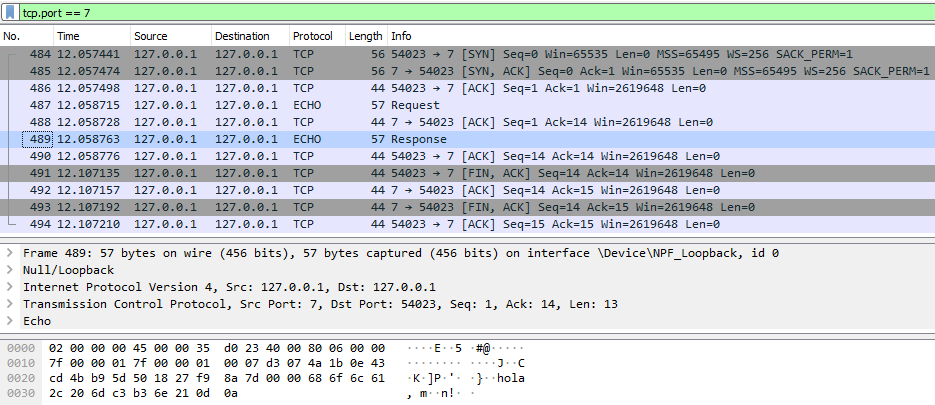

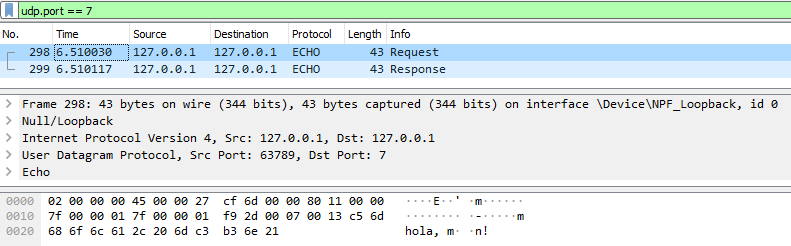

TCP necessita uns paquets de control per a establir la connexió en tres fases: SYN, SYN + ACK i ACK. Cada paquet enviat es contesta amb un ACK. I finalment, es produeix una desconnexió des de les dues bandes amb FIN + ACK i ACK.

UDP, en canvi, només transmet els paquets de petició / resposta, sense cap control sobre la transmissió.

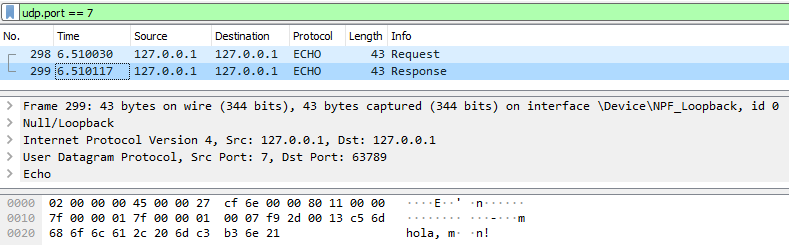

Protocol exemple: ECHO

A continuació es pot veure la visualització del protocol ECHO amb Wireshark, tant per a la implementació TCP com la UDP.

Captura TCP (petició i resposta)

Captura UDP (petició i resposta)

Protocol exemple: SMTP

SMTP és un protocol que funciona al port 25, sobre TCP. El client envia comandes, i el servidor respon amb un codi d’estat.

A continuació, veiem una conversa (C: client / S: servidor). Tota aquesta conversa es manté sobre una connexió oberta.

C: <client connects to service port 25>

C: HELO snark.thyrsus.com la máquina que envia s'identifica

S: 250 OK Hello snark, glad to meet you el receptor accepta

C: MAIL FROM: <esr@thyrsus.com> identificació de l'usuari que envia

S: 250 <esr@thyrsus.com>... Sender ok el receptor accepta

C: RCPT TO: cor@cpmy.com identificació del destí

S: 250 root... Recipient ok el receptor accepta

C: DATA

S: 354 Enter mail, end with "." on a line by itself

C: Scratch called. He wants to share

C: a room with us at Balticon.

C: . final de l'enviament multi-línia

S: 250 WAA01865 Message accepted for delivery

C: QUIT l'emissor s'acomiada

S: 221 cpmy.com closing connection el receptor es desconnecta

C: <client hangs up>

Comunicació TCP

Java té dues classes del paquet java.net que ho permeten:

Socket: implementació del sòcol client, que permeten comunicar dos programaris a la xarxa.ServerSocket: implementació del sòcol servidor, que permet escoltar peticions rebudes des de la xarxa.

El funcionament es reflecteix en les següents dues imatges: primer el client demana una connexió, i després el servidor l’accepta, i s’estableix.

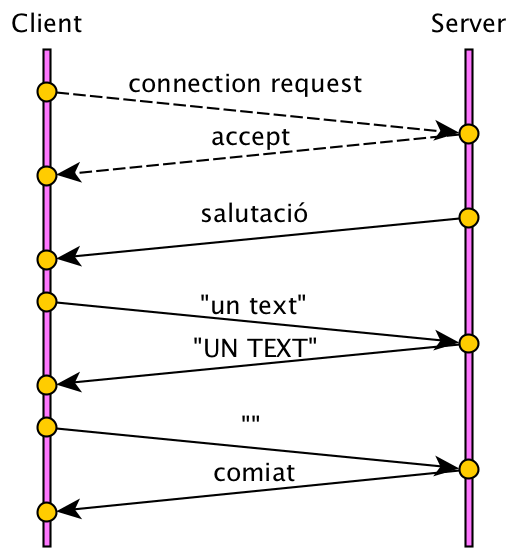

Servidor a majúscules

Aquest servidor escolta línies de text i retorna la versió en majúscules.

La comunicació comença amb la petició de connexió del client, i l’acceptació del servidor. Aquestes dues accions creen un sòcol compartit del tipus Socket, sobre el qual, tan el client com el servidor, poden utilitzar els mètodes:

getInputStream()getOutputStream()

El client pot enviar cadenes de text, que el servidor convertirà a majúscules.

El protocol que ens hem inventat estableix que la comunicació s’acaba quan el client envia una línia buida. a la qual el servidor contesta amb un comiat.

Aquest podria ser un codi del servidor que implementa el protocol descrit utilitzant TCP.

ServerSocket serverSocket = new ServerSocket(PORT);

Socket clientSocket = serverSocket.accept();

PrintWriter out = new PrintWriter(clientSocket.getOutputStream(), true);

BufferedReader in = new BufferedReader(new InputStreamReader(clientSocket.getInputStream()));

out.println("hola!");

String text;

while ((text = in.readLine()).length() > 0)

out.println(text.toUpperCase());

out.println("adeu!");

clientSocket.close();

serverSocket.close();

Pots provar-ho mitjançant la comanda netcat (nc).

Com seria el protocol d’aquest servei? En pseudocodi:

- Quan et connectes al servidor, envia una línia amb una salutació.

- Per cada línia que envies, et retorna la mateixa línia en majúscules.

- Quan envies una línia en blanc, et contesta amb el comiat, i es desconnecta.

A continuació, es pot veure un client que accedeix a aquest servei, implementant aquest protocol.

Socket clientSocket = new Socket(HOST, PORT);

PrintWriter out = new PrintWriter(clientSocket.getOutputStream(), true);

BufferedReader in = new BufferedReader(new InputStreamReader(clientSocket.getInputStream()));

String salutacio = in.readLine();

System.out.println("salutacio: " + salutacio);

for (String text: new String[]{"u", "dos", "tres"}) {

out.println(text);

String resposta = in.readLine();

System.out.println(text + " => " + resposta);

}

out.println();

String comiat = in.readLine();

System.out.println("comiat: " + comiat);

in.close();

out.close();

clientSocket.close();

Comunicació basada en text

Als exemples que hem vist, PrintWriter i BufferedReader són els objectes que permeten utilitzar cadenes de text sobre l’OutputStream i l’InputStream respectivament, que són mitjans de comunicació binària.

El més correcte en aquests casos seria indicar quin és el Charset amb que codifiquem els Strings. Si volguèssim utilitzar UTF-8, seria així:

Charset UTF8 = StandardCharsets.UTF_8;

PrintWriter out = new PrintWriter(new OutputStreamWriter(socket.getOutputStream(), UTF8), true);

BufferedReader in = new BufferedReader(new InputStreamReader(socket.getInputStream(), UTF8));

Relacionat amb el charset, tenim la conversió des de i cap a String a partir de dades binàries, que podem realitzar a UDP. Aquestes són les dues operacions:

byte[] strBytes = "Hola, món!".getBytes(UTF8);

String str = new String(strBytes, UTF8);

Comunicació UDP

Amb UDP no hi ha connexió: simplement s’envien paquets (Datagrames) amb destinació un servidor UDP. Si volem respondre, cal conèixer l’adreça i port destí, que pot obtenir-se del paquet rebut.

Un servidor es pot crear amb:

DatagramSocket socket = new DatagramSocket(PORT)

El client funciona exactament igual, però el socol es crea amb:

DatagramSocket socket = new DatagramSocket();

Per rebre un paquet de mida màxima MIDA:

byte[] buf = new byte[MIDA];

DatagramPacket paquet = new DatagramPacket(buf, MIDA);

socket.receive(paquet);

// dades a paquet.getData() i origen a paquet.getAddress() i paquet.getPort()

Per enviar un paquet al servidor:

InetAddress address = InetAddress.getByName(HOST);

paquet = new DatagramPacket(buf, MIDA, address, PORT);

socket.send(paquet);

Per enviar un paquet de resposta a un client, hem d’utilitzar el port que hi ha al paquet que ens ha enviat prèviament:

InetAddress address = paquetRebut.getAddress();

int port = paquetRebut.getPort();

DatagramPacket paquetResposta = new DatagramPacket(buf, buf.length, address, port);

socket.send(paquet);

Concurrència

Com podem fer que els servidors acceptin peticions concurrents de diversos clients?

Ho vam veure a la UF “Processos i fils”. Caldria atendre cada petició a un fil diferent. Per exemple, per al cas de TCP:

Executor executor = Executors.newFixedThreadPool(NFILS);

ServerSocket serverSocket = new ServerSocket(PORT);

while (true) {

final Socket clientSocket = serverSocket.accept();

Runnable tasca = new Runnable() {

public void run() {

atendrePeticio(clientSocket);

}

};

executor.execute(tasca);

}

D’aquesta manera, no fem esperar nous clients quan atenem un.

Timeouts

Quan utilitzem sòcols TCP, les operacions de connexió i enviament de dades requereixen la confirmació de l’altra part. Per defecte, l’API que hem vist no té temporitzadors (timeouts), i es bloqueja indefinidament.

També hi ha l’operació UDP de llegir un datagrama, que per defecte es bloqueja esperant la resposta.

Aquestes són les operacions de connexió TCP:

new Socket(host, port...): creació d’un sòcol i connexió sense timeout.new Socket(): creació d’un sòcol no connectat (no hi ha bloqueig).Socket.connect(SocketAddress, timeout): connexió d’un sòcol no connectat amb un timeout.

Un cop creat un sòcol TCP, sigui de client (Socket) o de servidor (ServerSocket), podem canviar la temporització utilitzant Socket.setSoTimeout(int timeout). Quan es cumpleix el temporitzador, es llença una excepció de tipus SocketTimeoutException. Aquest timeout (en mil·lisegons) afecta les següents operacions TCP/UDP:

ServerSocket.accept(): acceptació d’una connexió d’un client al servidor TCP.SocketInputStream.read(): lectura de dades a un sòcol TCP.DatagramSocket.receive(): lectura d’un datagrama UDP.

Tancament

Aquests són alguns aspectes associats al tancament d’un sòcol TCP:

- Podem comprovar si una connexió TCP està tancada amb

Socket.isClosed()iServerSocket.isClosed(). - Si tanquem la connexió d’un sòcol amb

Socket.close(), es tanquen automàticament els seus streamsInputStreamiOutputStream. - Si tanquem la connexió de qualsevol dels seus streams, es tanca automàticament la del sòcol associat.

- Si fem un

ServerSocket.close()i s’està esperant amb unServerSocket.accept(), s’interromprà i hi haurà una SocketException. - Si un sòcol està esperant amb un

SocketInputStream.read()i el sòcol de l’altra banda es tanca, elread()s’interromprà i hi haurà una SocketException. - Si un sòcol està esperant en un canal de text amb un

BufferedReader.read()oBufferedReader.readLine()i el sòcol de l’altra banda es tanca, es retornarà -1 i null, respectivament.

Comunicació asíncrona

Basada en les llibreries NIO. Veure aquest post.

Serveis

Arquitectures

Una aplicació pot veure’s com quatre components: les dades, la lògica d’accés a dades, la lògica de l’aplicació i la presentació. Aquests components es poden distribuir de moltes formes:

- basades en servidor: el servidor fa pràcticament tota la feina. Els clients són molt lleugers.

- basades en client: el client fa pràcticament tota la feina. El servidor només guarda les dades.

- peer-to-peer: les màquines fan de client i servidor i comparteixen la feina, que fan integralment.

- client/servidor: l’arquitectura dominant. La lògica de l’aplicació i d’accés a dades pot estar distribuïda entre client i servidor. Poden tenir múltiples capes: 2, 3, N. Permet integrar aplicacions de diferents proveïdors utilitzant protocols estàndard. Aquesta és l’arquitectura dominant.

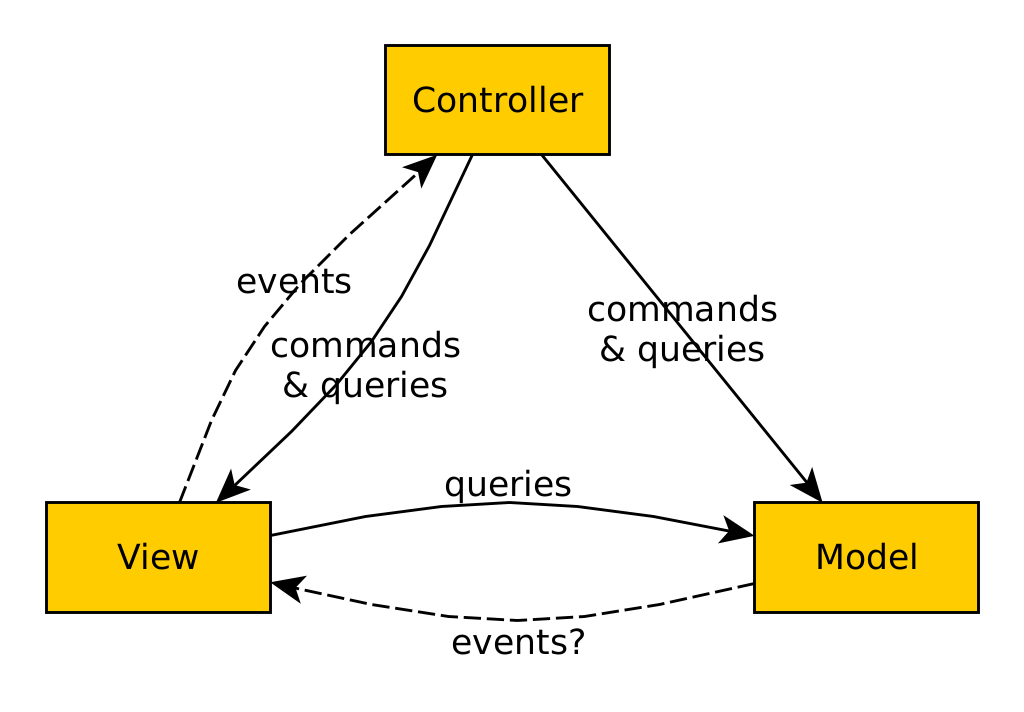

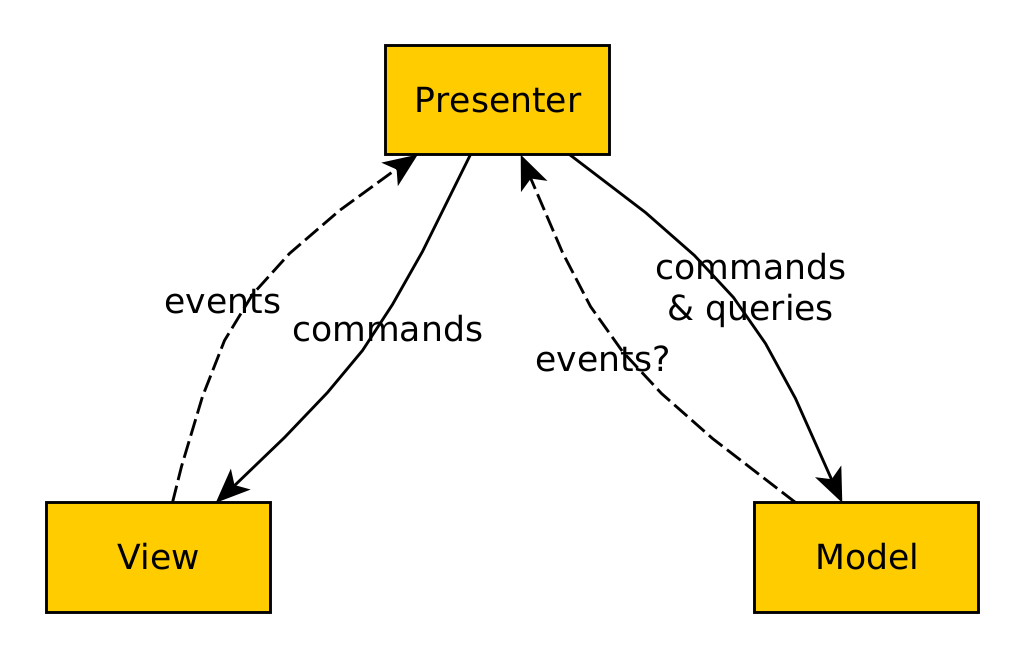

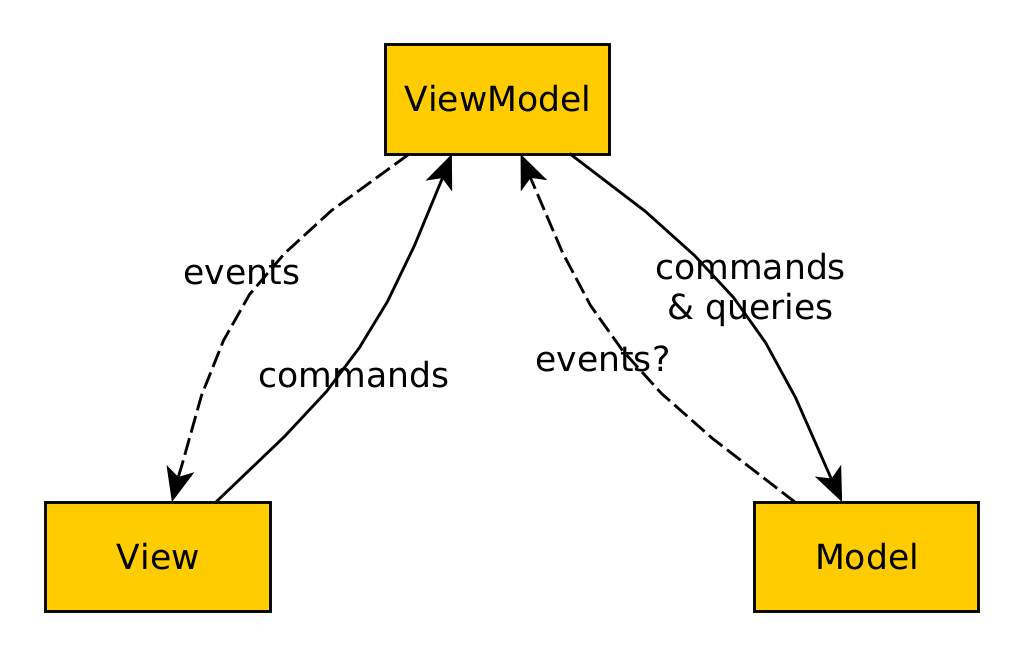

L’arquitectura client/servidor està centrada habitualment en les dades: la lògica de negoci s’interposa entre aquestes dades i la interfície d’usuari, habitualment web. Un exemple de patró és el MVC (model/vista/controlador).

Si atenem al criteri d’on es genera l’HTML d’una aplicació web podem tenir:

- El tradicional: l’HTML es genera al servidor.

- El SPA (Single-Page Application): l’HTML es genera al client, i amb el servidor s’intercanvien dades (JSON, habitualment). Al servidor implementem APIs basades en HTTP, que poden compartir-se amb diferents tipus de clients com navegadors o aplicacions per mòbil.

Quan les funcionalitats creixen i s’afegeixen a una solució, tenim el risc de convertir la nostra aplicació en el que s’anomena aplicació monolítica. Algunes solucions arquitecturals proposen solucions:

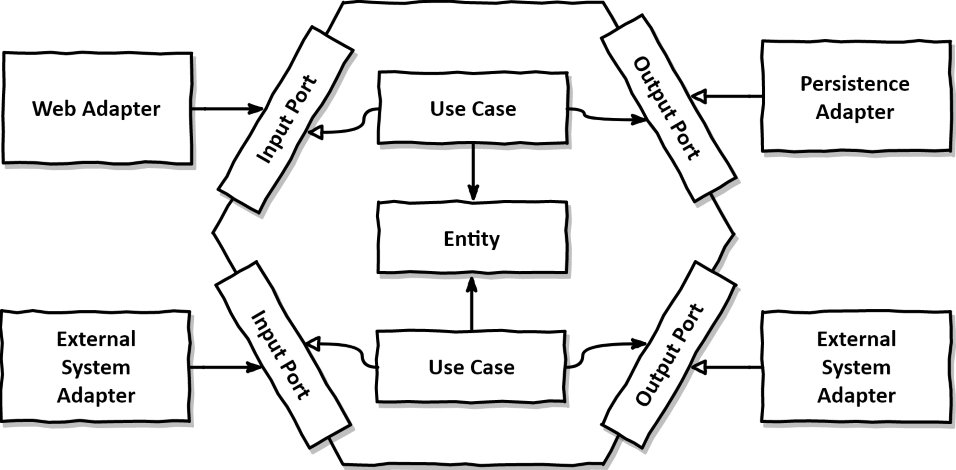

- Arquitectura de microserveis: proposa serveis completament independents que proporcionen funcionalitats autocontingudes. Tots ells es comuniquen amb protocols lleugers (poden ser heterogenis) basats en REST/HTTP gràcies a un contracte ben establert (API). Basats en l’idea del bucle d’esdeveniments.